DROID (2024)

·

数据集介绍

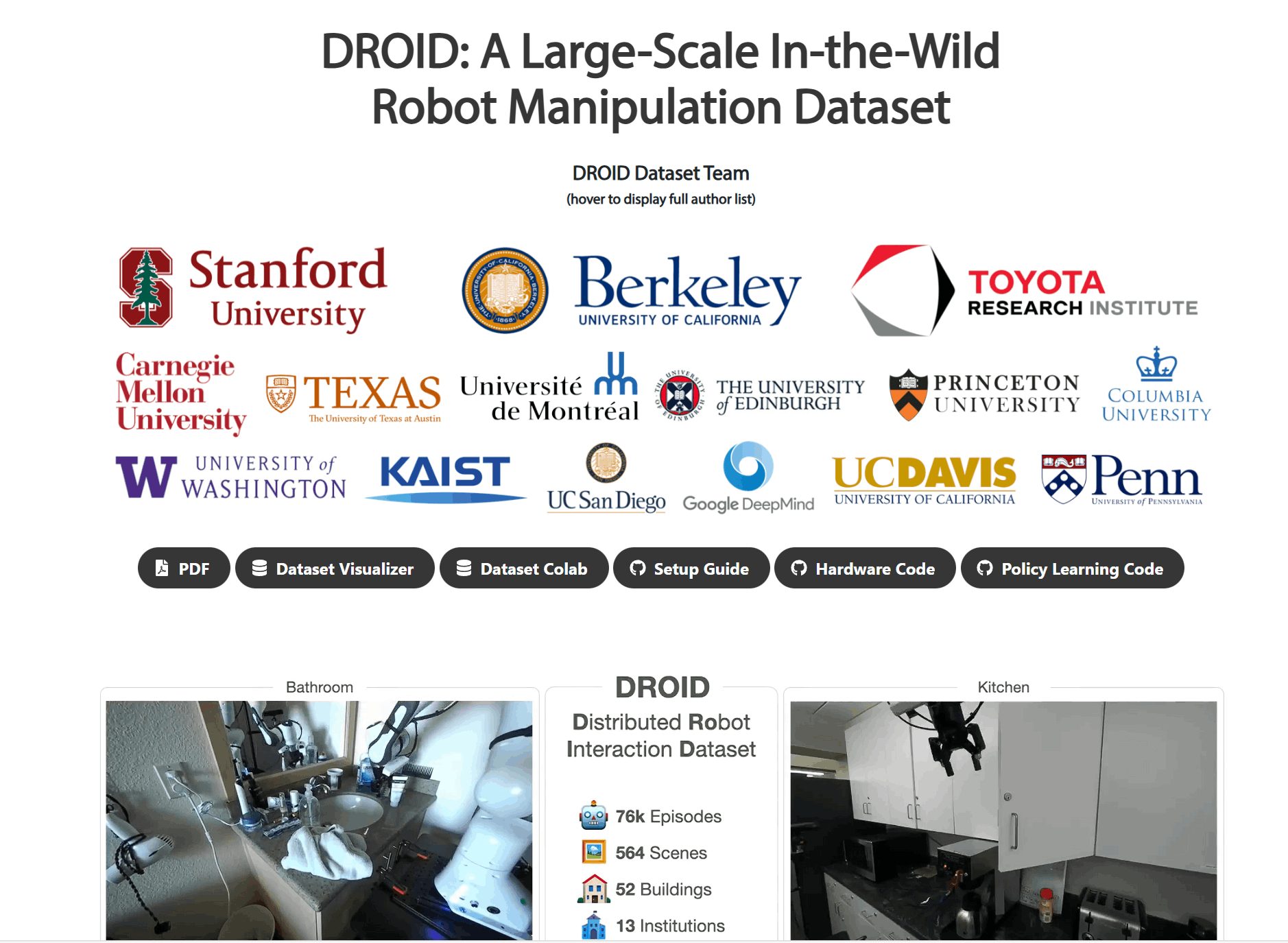

DROID (2024) 数据集由斯坦福大学联合全球13家顶尖研究机构共同打造,是一个大规模、高多样性的真实世界机器人操作数据集。该数据集旨在解决现有机器人操作策略因训练数据场景和任务多样性有限而导致的泛化能力不足问题,通过分布式采集策略收集了横跨三大洲的真实环境数据。

- 任务时序长度:以短程任务为主,单次示范持续数秒,每个轨迹平均包含多步连续操作。

- 动作可执行性:基于VR遥操作进行低级控制,支持关节控制或末端执行器控制,控制频率为5 Hz。

- 时序连续性:数据以“episode”形式记录多步连续传感信息与动作序列,完整保留操作过程。

- 语言控制:95%以上的成功轨迹附有自然语言指令标注,支持语言条件控制。

主要特点

- 全球分布式采集:由50名数据收集者在北美、亚洲、欧洲三大洲完成采集,覆盖不同地域的环境特征。

- 高度场景多样性:数据采集自564个不同的真实场景,远超以往数据集的场景规模。

- 标准化硬件配置:所有采集点采用统一的硬件配置(Franka Panda机械臂 + ZED立体相机),确保数据一致性。

- 大规模真实数据:总计76,000条示范轨迹,约350小时的交互数据,是当前规模最大的跨场景真实机器人操作数据集之一。

- 任务覆盖广泛:涵盖86种不同的操作任务,由13家机构在真实环境中分布式采集。

数据来源

- 采集平台:基于Franka Panda 7自由度机械臂,搭载ZED 2和ZED Mini立体相机,使用Oculus Quest 2头显进行VR遥操作控制。

- 机构合作:由斯坦福大学主导,联合Mila、UC Berkeley、CMU等13家学术机构在全球范围分布式采集。

- 数据形式:全部为真实物理环境遥操作采集数据,包含RGB图像、深度信息及机器人动作序列。

规模

- 总示范轨迹:76,000条机器人操作演示轨迹。

- 数据时长:约350小时的交互数据。

- 场景数量:564个不同的真实环境场景。

- 任务类别:覆盖86种不同的操作任务。

应用场景

数据集覆盖广泛真实世界物理操作任务,特别适合需要跨场景泛化能力的机器人学习研究:

- 跨场景泛化研究:由于数据来自全球多个地区的大量不同场景,特别适合训练和评估机器人策略的环境泛化能力。

- 多任务操作学习:涵盖86种不同任务类型,支持训练能够处理多种日常操作任务的通用策略。

- 真实环境部署:数据全部采集自真实世界环境(非仿真),训练出的策略更易于在真实场景中部署应用。

- 遥操作学习:基于VR遥操作的采集方式,为模仿学习提供了高质量的人类示范数据。

官方网站

更多推荐

已为社区贡献12条内容

已为社区贡献12条内容

所有评论(0)