CVPR 2026!地平线11篇论文入选(端到端/场景重建/世界模型/具身智能等)

点击下方卡片,关注“自动驾驶之心”公众号戳我-> 领取自动驾驶近30个方向学习路线>>自动驾驶前沿信息获取→自动驾驶之心知识星球近日,计算机视觉与模式识别领域国际顶会CVPR 2026 (IEEE/CVF Conference on Computer Vision and Pattern Recognition) 正式公布论文收录结果。地平线凭借深厚的技术积淀与前瞻的科研布局,共有11篇论文成功入

点击下方卡片,关注“自动驾驶之心”公众号

作者 | 地平线HorizonRobotics

编辑 | 自动驾驶之心

本文只做学术分享,如有侵权,联系删文

>>自动驾驶前沿信息获取→自动驾驶之心知识星球

近日,计算机视觉与模式识别领域国际顶会CVPR 2026 (IEEE/CVF Conference on Computer Vision and Pattern Recognition) 正式公布论文收录结果。地平线凭借深厚的技术积淀与前瞻的科研布局,共有11篇论文成功入选,覆盖端到端自动驾驶、3D重建、世界模型、具身智能等多个核心领域,充分彰显地平线在前沿技术领域的顶尖研发水平。

CVPR如同连接学术与产业的 “黄金桥梁”,一端锚定前沿理论的创新高地,另一端衔接产业落地的实践沃土,让实验室里的技术构想,通过这座桥梁转化为赋能千行百业的实际价值。作为全球计算机视觉领域的顶级会议,CVPR每年吸引全球超万份高质量论文投稿,仅有少数兼具创新性与实用性的研究成果能够脱颖而出。

本文将分享地平线此次入选的11篇研发工作。

基于归一化残差轨迹建模的 端到端自动驾驶新范式

-

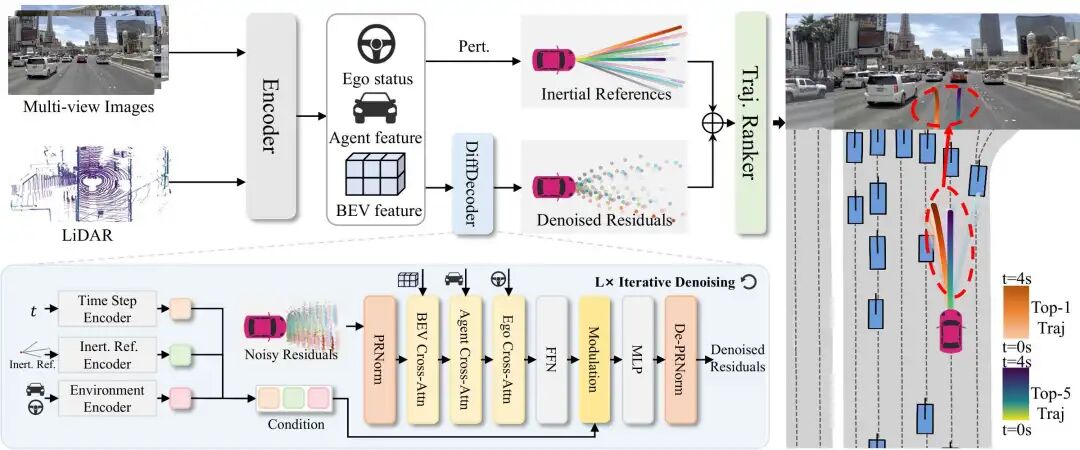

论文题目:ResAD: Normalized Residual Trajectory Modeling for End-to-End Autonomous Driving

-

论文链接:https://arxiv.org/abs/2510.08562

-

项目主页:https://duckyee728.github.io/ResAD

端到端自动驾驶 (E2EAD) 系统因轨迹数据固有的时空不平衡性,面临模型易学习虚假关联、优化过程过度关注远距离不确定预测而牺牲即时安全的核心难题。针对上述问题,地平线提出ResAD,为E2EAD打造了全新的轨迹预测范式,核心创新点与技术突破体现在重构学习任务、优化目标加权、实现高效多模态规划三大维度,大幅简化了模型学习难度并提升规划性能。

ResAD摒弃直接预测未来轨迹的传统思路,先基于自车当前状态通过恒速模型生成惯性参考轨迹这一稳健的物理先验,将学习任务重构为预测实际轨迹相对该参考的残差偏差,迫使模型聚焦于学习由交通规则、障碍物等场景上下文驱动的必要修正,而非从头学习复杂的时空动力学,从根源上避免虚假关联的学习。针对长时程预测的不确定性导致的优化失衡问题,提出逐点残差归一化 (PRNorm) 技术,对预测残差进行分量级归一化并重新加权优化目标,有效解决了远距离航点的大幅误差主导学习信号的问题,保障了近场安全关键微调的精准捕捉。同时,设计惯性参考扰动 (IRP) 策略,通过对自车初始速度添加随机扰动生成多样化的惯性参考,无需依赖静态预定义轨迹词汇表,即可生成符合场景上下文的多模态轨迹假设,结合自研的轨迹排序器实现最优轨迹筛选,突破了传统多模态规划效率低、轨迹可行性差的局限。

ResAD通过从任务本质重构E2EAD的轨迹预测逻辑,成功解决了原始轨迹数据的时空不平衡难题,为端到端自动驾驶构建了更鲁棒、稳定且可扩展的技术基础,相关代码将开源以推动后续研究。

用测试时训练补上全局上下文 迈向公里级三维重建

-

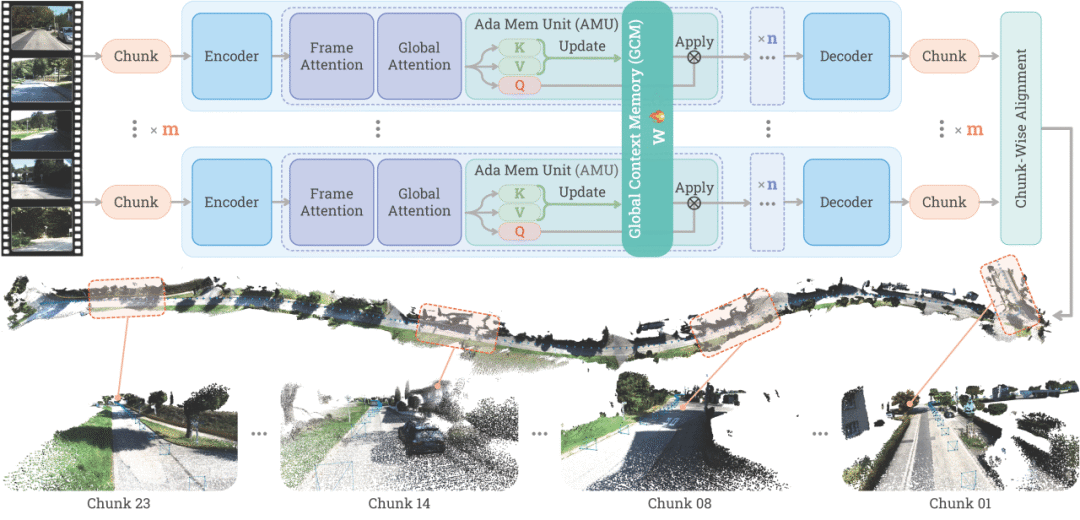

论文题目:Scal3R: Scalable Test-Time Training for Feed-forward Large-Scale 3D Reconstruction

大规模长序列三维重建在自动驾驶、机器人建图、数字孪生等场景中具有重要应用价值,但现有方法在“规模”与“精度”之间始终存在明显矛盾:以VGGT为代表的feed-forward几何模型虽然具备很强的局部重建能力,却受限于注意力的二次复杂度,难以直接扩展到超长序列和公里级场景;FastVGGT通过token压缩换取更高效率,却不可避免地损失细粒度几何信息和长程依赖;VGGT-Long则依赖chunk切分与后期对齐来处理长序列,但由于缺乏真正的全局上下文共享,模型对局部预测误差高度敏感,容易在跨chunk重建中积累不一致,影响整体结构稳定性。针对这一核心瓶颈,本文提出Scal3R,将Test-Time Training引入大规模三维重建过程,在仅使用RGB输入的条件下实现对长序列全局上下文的高 效建模,为公里级场景重建提供了一种兼顾精度、一致性与扩展性的全新方案。

Scal3R的核心创新集中在全局上下文表示与跨chunk上下文同步两大层面。在全局上下文表示方面,作者提出Global Context Memory (GCM) 机制,将一组轻量神经子网络作为可快速适配的“神经记忆单元”,挂接在VGGT的全局注意力层后,并通过自监督目标在测试阶段在线更新,从而把长程场景信息压缩进可持续演化的上下文表示中。与传统固定长度 记忆或简单缓存不同,这种设计显著提升了模型对长程依赖的承载能力,让局部重建能够获得更充分的全局先验。在跨chunk聚合方面,进一步提出Global Context Synchronization (GCS) 机制,将不同chunk、不同设备上的上下文更新进行高效同步,使每个局部块在推理时都能共享来自全序列的全局信息,缓解传统chunk-by-chunk方案中常见的跨段 不一致、局部误差放大以及全局结构松散等问题。借助这一设计,Scal3R不只是把长序列“切开来算”,而是真正让全局上下文参与到局部几何推理之中,从根本上增强了大场景重建的稳定性与一致性。

实验结果表明,Scal3R在KITTI Odometry、Oxford Spires、Virtual KITTI、ETH3D等多个大规模基准上取得了领先的位姿估计和三维重建表现,尤其在长序列、复杂视角变化和大尺度场景下,相比现有feed-forward、streaming memory-based方法以及chunk对齐方案展现出更强的全局一致性与几何鲁棒性。同时,该方法在效率上也保持了较好的实用性:既避免了长上下文Transformer常见的显存膨胀问题,也显著快于依赖重型全局优化的传统SfM流程。总体来看,Scal3R将test-time adaptation、长程上下文建模与大规模三维几何推理有机结合,为“仅凭RGB实现高质量公里级场景重建”提供了一条很有代表性的技术路线,也为今后长序列三维感知系统的可扩展设计带来了新的启发。

突破纯视觉流式三维重建瓶颈 LongStream赋能公里级流式重建

-

论文题目:LongStream: Long-Sequence Streaming Autoregressive Visual Geometry

-

论文链接:https://arxiv.org/abs/2602.13172

-

项目主页:https://3dagentworld.github.io/longstream

长序列流式三维重建在自动驾驶、机器人与AR/VR等场景中具有重要价值,但现有流式自回归模型在长序列中普遍快速失稳。其根源在于,主流方法采用首帧锚定的绝对位姿建模,训练时只见短序列,推理时却要处理远超训练范围的长视频流,因而产生明显的train-short, test-long域偏差,推理时被迫进行越来越困难的长程外推,最终导致误差累积、轨迹漂移与几何崩溃。同时,这类模型还表现出与大语言模型类似的attention sink现象,注意力异常沉积于首帧token,而非对重建更关键的时空邻近帧,从而违背了局部几何约束;长期累积的KV cache也会带来表征污染、记忆饱和与几何漂移。多种因素叠加,使现有方法往往在数十米范围内便迅速失效。

针对这一核心瓶颈,LongStream从流式几何学习的建模范式出发进行了系统重构。该方法采用Gauge-Decoupled设计,摆脱首帧锚定的绝对位姿回归方式,转而预测当前帧相对于最近关键帧的位姿,将随序列长度不断恶化的长程外推问题转化为难度基本恒定的局部估计问题,从根本上削弱了对固定全局坐标系和首帧锚点的依赖。在此基础上,LongStream进一步识别出attention sink和长期KV-cache污染是长时退化的主要来源,并提出 缓存一致性训练,通过在训练阶段显式传递和裁剪缓存,使训练时的可见上下文与真实流式推理保持一致,引导模型在滑动窗口条件下学习稳定的局部时序依赖,而非继续依赖首帧“沉积”注意力。

同时,该方法结合周期性缓存刷新,定期边缘化陈旧上下文,清理退化记忆,抑制长期饱和与几何漂移。由于整个系统建立在关键帧相对坐标系之上,缓存可在关键帧处刷新而不破坏重建一致性,从而使模型获得更接近“无限流”处理的能力。基于这一系列设计,LongStream实现了公里级、实时、稳定的流式三维重建,为长序列视觉几何建模提供了更鲁棒、更可扩展的技术方案。其对长序列失效原因的识别和分析为相关领域研究提供了重要借鉴,有望推动流式重建模型在自动驾驶、AR/VR等实际应用场景的技术落地。

推动事件相机迈向驾驶智能 构建全栈事件语言基准

-

论文题目:EventDrive: Event Cameras for Vision–Language Driving Intelligence

事件相机具备微秒级时间分辨率、高动态范围和抗运动模糊等优势,在高速运动、强光炫光和低照度等场景中,相比传统帧相机更能稳定捕捉动态变化。但现有研究大多集中在检测、分割、跟踪等低层感知任务,尚未系统回答一个关键问题:事件信号能否进一步服务于自动驾驶中的高层语义理解、行为预测与决策规划。EventDrive围绕这一问题展开,首次将事件流、RGB图像与语言监督统一到自动驾驶全流程框架中,推动事件视觉从“感知增强”走向“智能驱动”。

为填补这一空白,EventDrive构建了首个面向自动驾驶全栈智能的事件-语言基准,将任务统一划分为Perception、Understanding、Prediction和Planning四个层级,共覆盖17个子任务,形成约47.6万条 事件-帧-语言样本,为评测事件相机在驾驶智能中的实际价值提供了系统平台。相较以往主要关注caption或简单问答的数据集,EventDrive首次把事件模态推进到自动驾驶“感知—理解—预测—规划”的完整闭环中。

在模型层面,论文进一步提出EventDrive-VLM。该方法通过 多时间尺度事件体素化 与 动态时间域事件编码 建模不同频率和运动模式下的事件特征,并引入Event Q-Former提取与语言任务相关的运动表征,实现事件模态、图像模态与语言推理空间之间的有效对齐。大量实验表明,EventDrive-VLM在多类驾驶推理任务上取得了显著提升,尤其在动态变化、运动状态和时序推理相关任务中,事件信号展现出对传统帧模态的重要补充价值。

EventDrive的提出,为事件相机融入自动驾驶高层智能系统提供了新的研究范式,也为未来构建更鲁棒、更高时效的多模态驾驶系统奠定了基础。

贯通“视觉-几何-功能-人类感知” 驾驶世界模型闭环评估新范式

-

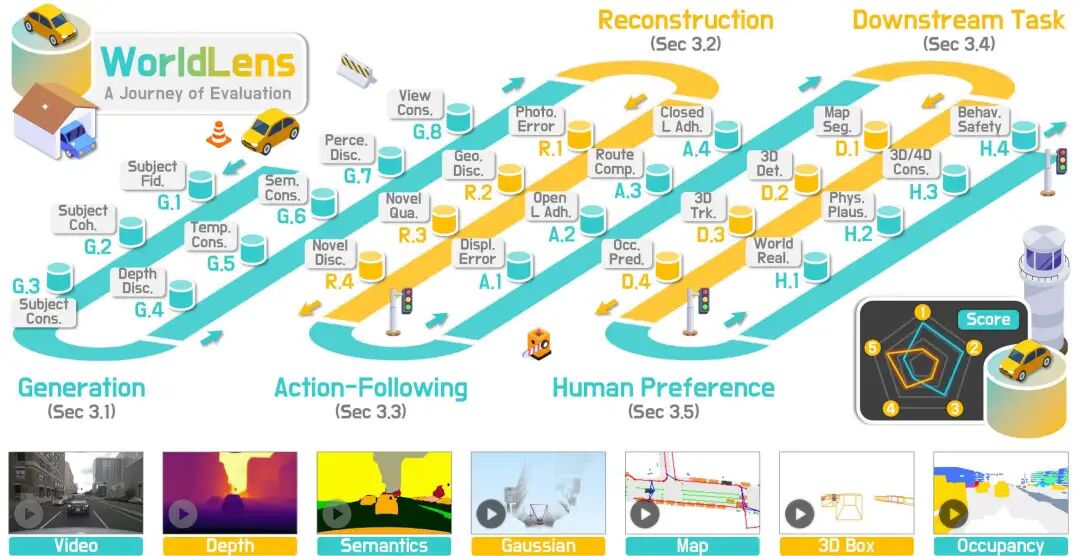

论文题目:WorldLens: Full-Spectrum Evaluations of Driving World Models in Real World

-

论文链接:https://arxiv.org/abs/2512.10958

-

项目主页:https://worldbench.github.io/worldlens

当前驾驶场景生成式世界模型虽能合成高视觉真实感的4D环境,但普遍存在物理逻辑违规、几何一致性缺失、功能可用性不足等问题,且行业缺乏统一的综合评估标准,现有指标仅侧重帧级视觉质量,难以衡量物理合理性、多视图一致性及实际应用价值。针对这一核心痛点,本文提出WorldLens—— 首个覆盖 “生成质量、重建一致性、动作跟随性、下游任务适配、人类偏好” 五大维度的全光谱评估基准,配套构建WorldLens-26K大规模人类偏好数据集与WorldLens-Agent自动评估模型,形成 “基准-数据集-评估代理” 三位一体的完整评估生态,实现对驾驶世界模型 “视觉真实感、几何一致性、物理plausibility、功能可靠性” 的全方位量化与解读。

其核心创新性体现在三大维度:一是评估维度的全景化突破,首次将4D重建一致性、闭环动作跟随性、下游感知任务适配性与人类主观偏好纳入统一框架,拆解为24个细粒度子维度,覆盖从低阶视觉特征到高阶行为逻辑的全链路评估;二是评估体系的人机协同创新,通过26808条含文本理由的人类标注数据,建立客观指标与人类感知的映射关系,进而训练出WorldLens-Agent自动评估模型,该模型基于Qwen3-VL-8B微调,可实现零样本场景下与人类判断高度对齐的量化评分及可解释性推理,解决人工评估效率低、主观性强的痛点;三是评估指标的功能导向创新,引入闭环仿真(如Route Completion、ADS分数)、下游感知任务(3D检测、占用预测)等功能性指标,突破传统视觉评估的局限,实现对模型 “能用、好用” 的核心诉求的量化。

实验验证显示,现有主流模型均无全能表现:DiST-4D在几何重建与下游任务适配中表现最优,OpenDWM在视觉真实感上领先,而所有模型在闭环动作跟随性上仍存在显著短板(路线完成率普遍低于 15%)。WorldLens通过标准化评估流程与工具链,不仅揭示了当前模型在 “视觉真实” 与 “物理/功能真实” 间的核心矛盾,更提供了精准的缺陷诊断能力,为驾驶世界模型从 “看起来真实” 向 “行为真实、可用可靠” 的进化提供了关键技术支撑。

突破大规模3D重建效率瓶颈 实现千图序列10×加速

-

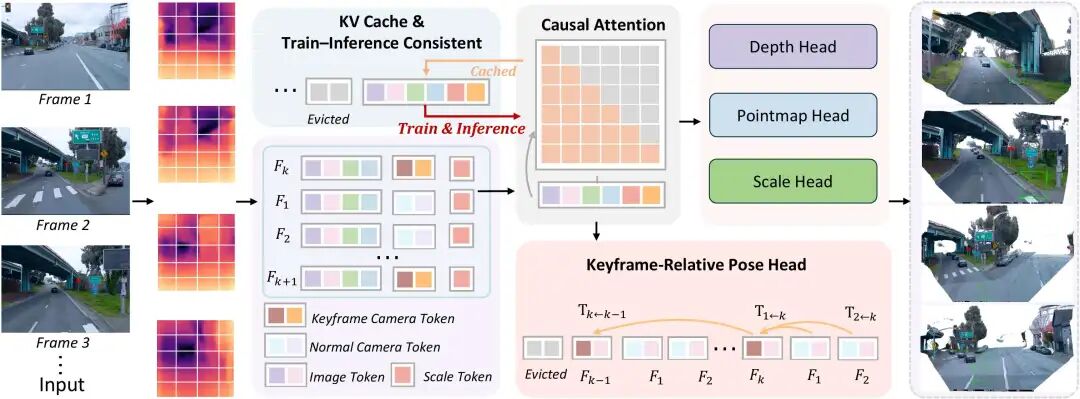

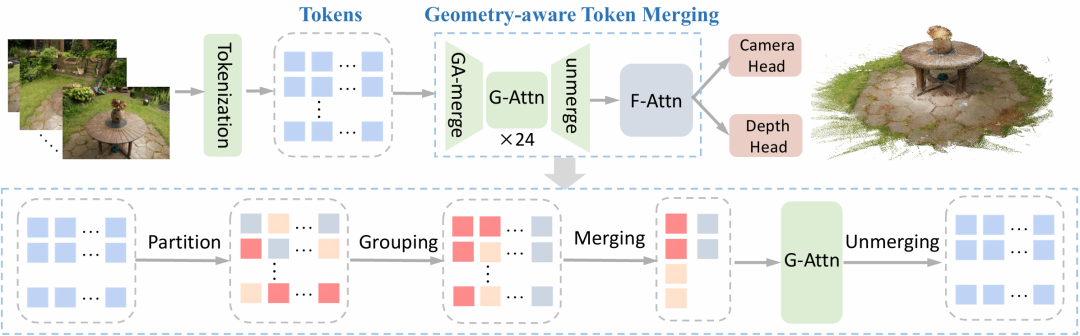

论文题目:LiteVGGT: Boosting Vanilla VGGT via Geometry-aware Cached Token Merging

-

论文链接:https://arxiv.org/abs/2512.04939

-

项目主页:https://garlicba.github.io/LiteVGGT

VGGT作为3D视觉基础模型,在多视图3D重建任务中表现卓越,但因其Transformer架构的全局注意力机制存在二次计算与内存复杂度,处理长序列图像时易出现内存溢出 (OOM) 、推理耗时过长等问题,难以适配大规模场景应用。针对这一核心痛点,本文提出LiteVGGT,通过创新的几何感知缓存token merging策略,在保持VGGT核心重建精度的前提下,实现了10倍推理加速与显著内存节省,并支持千图级图像序列的高效单次推理3D重建。

LiteVGGT的核心贡献体现在三个方面:首先,提出几何感知token优先级划分机制,通过识别对三维几何结构最关键的视觉token,在减少计算量的同时保留重建所需的关键几何信息;其次,设计跨层缓存融合索引策略,复用相邻global attention层的token融合索引,在仅带来轻微精度下降的情况下显著降低推理时延;此外,结合多源数据精细化微调与FP8量化推理,进一步提升模型运行效率并降低显存占用,构建完整的高效推理优化方案。

实验结果表明,LiteVGGT在ScanNet-50、Tanks & Temples等多种室内外大规模场景数据集上表现出色:在处理1000张图像序列时,相比原始VGGT实现10倍 推理加速,显存占用显著降低,同时点云重建精度和相机姿态估计性能均接近原模型。该方案无需修改VGGT核心架构,具有良好的兼容性与工程落地能力,可为自动驾驶、AR/VR等应用场景提供高效的大规模三维重建能力。

深度赋能+区域自适应 破解视觉3D占用预测两大核心痛点

-

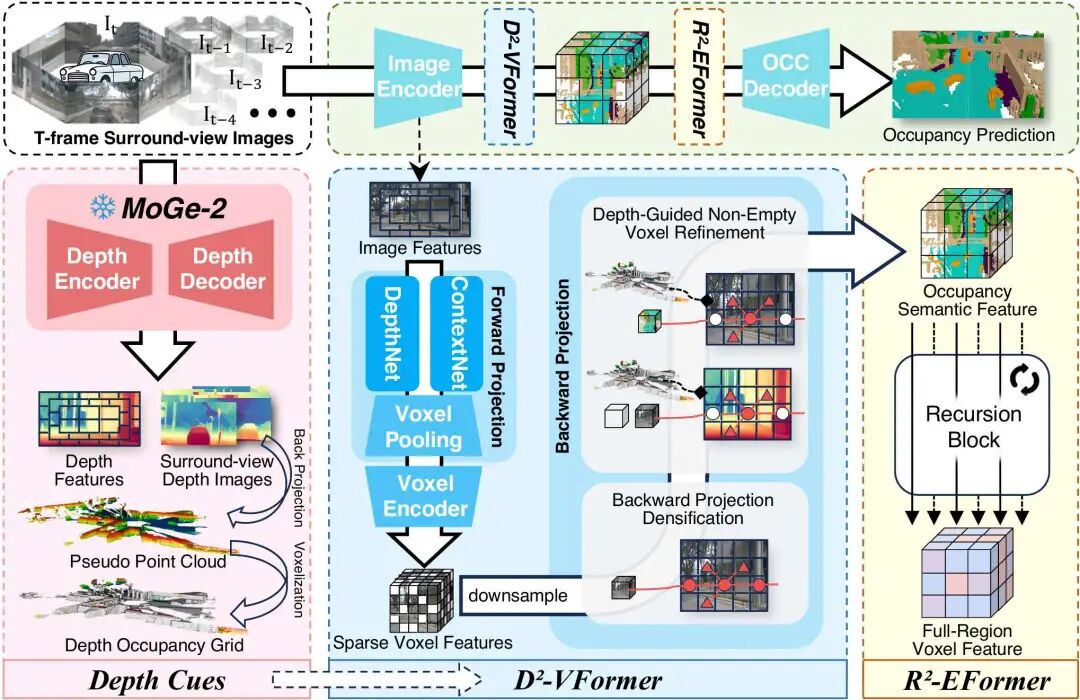

论文题目:Dr.Occ: Depth- and Region-Guided 3D Occupancy from Surround-View Cameras for Autonomous Driving

-

论文链接:https://arxiv.org/abs/2603.01007

3D语义占用预测是自动驾驶感知的核心任务,但其视觉-based方法长期面临两大关键瓶颈:一是2D到3D视图转换中因低分辨率、高噪声深度估计导致的几何错位,二是语义类别空间分布各向异性引发的严重类别不平衡。针对上述痛点,本文提出Dr.Occ—— 深度与区域双引导的3D占用预测框架,通过创新的几何增强与语义建模模块实现协同优化,在Occ3D-nuScenes基准上较强基线BEVDet4D提升7.43% mIoU与3.09% IoU,且可无缝集成至SOTA方法COTR并额外提升1.0% mIoU,展现出极强的通用性与工程价值。

本项目核心创新在于两大技术突破:其一,提出深度引导双投影视图Transformer (D²-VFormer) 。针对实验发现的“直接融合深度图易导致性能退化”这一挑战,该模块利用MoGe-2生成的高质量深度线索构建体素级掩码 (Voxel-level Masks) ,引导模型精准聚焦非空区域。通过“前向投影下采样-反向投影致密化-深度引导非空精炼”三阶段流程,有效攻克了2D-to-3D转换中的几何错位难题,实现了深度基准模型向3D占用任务的高效迁移。其二,提出区域引导专家Transformer (R-EFormer) 及其递归变体R²-EFormer。该方法基于3D空间语义分布的强位置偏好,将传统混合专家 (MoE) 的通道激活机制升华为空间维度的选择性专家建模。通过为不同空间区域自适应分配专属专家,该架构有效捕捉了复杂的空间异构语义,并显著提升了稀有类别的识别召回率,为3D占用任务提供了全新的空间特征融合范式。

机器人首次实现语义进展推理 零标签在指令结构中定位任务进展

-

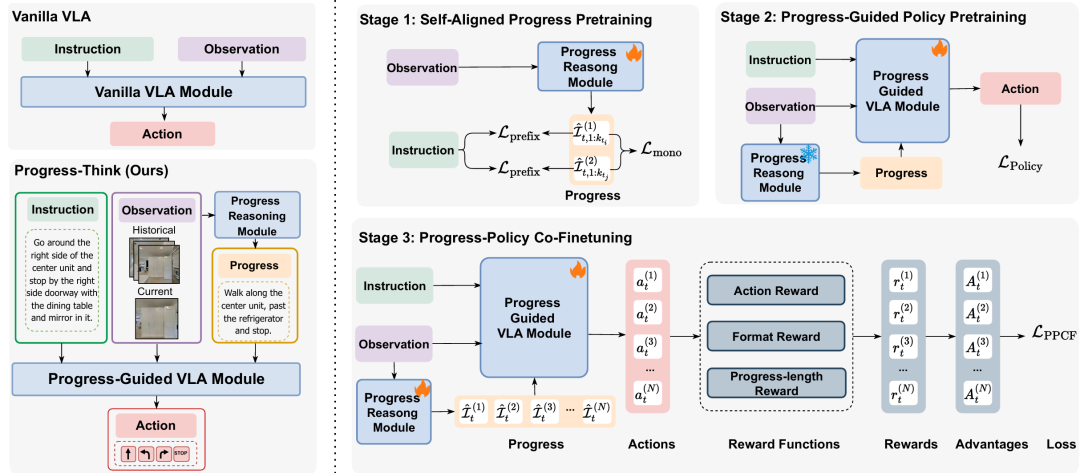

论文题目:Progress-Think: Semantic Progress Reasoning for Vision-Language Navigation

-

论文链接:https://arxiv.org/abs/2511.17097

-

项目主页:https://horizonrobotics.github.io/robot_lab/progress-think

在视觉语言导航 (VLN) 中,机器人长期缺乏一种关键能力:它能持续前进,却无法判断自己的任务推进到了哪一步。导航在空间中不断展开,画面节节推进,但模型并不知道自己在自然语言指令里处于什么阶段,因此容易漂移、兜圈,或做出难以解释的决策。我们认为,引入语义进展推理,是破解长程导航不稳定性的关键路径。

为了在没有进展标注的情况下习得进展定位能力,我们设计了一个三阶段的学习框架。第一阶段,通过前缀对齐的自监督训练,模型在视觉轨迹中自动推断出与指令前缀的对应关系,使“当前观察对应哪一语义段落”成为一种内生表征,而非依赖外部标注。第二阶段,我们将进展表示作为上下文注入导航VLA策略,使决策在结合指令和观测的同时,也能参考自身的任务进展,从而形成明确的语义方向感。第三阶段,通过进展推理与导航VLA策略的联合优化,使模型在推理时保持一致、稳健的进展定位能力,并形成从语义对齐到动作生成的完整闭环。

在三阶段学习下,进展不再是一个回归值或附加标签,而演化为贯穿视觉理解、语义推理与行动决策的结构性信号。机器人由此首次具备真正的“进展定位”能力,能够在执行中持续推理“我完成到哪了”,并据此更清晰地决策“下一步该做什么”。

Progress-Think让机器人第一次具备语义层面的“进展坐标系”。我们首次揭示了视觉观测序列与指令语义之间的结构性关联,并将其提炼为可学习的进展信号,使模型无需额外标注即可学会思考:“我刚完成了什么”。通过自监督的进展对齐、进展引导决策以及进展–策略联合微调,仅凭单目相机输入,模型就能显著减少偏航并提升稳定性。Progress-Think在R2R-CE等标准数据集上取得领先表现,并进一步推动具身推理朝更明确的任务导向发展。

从解耦到统一 以通用高斯范式突破3D重建与语义理解边界

-

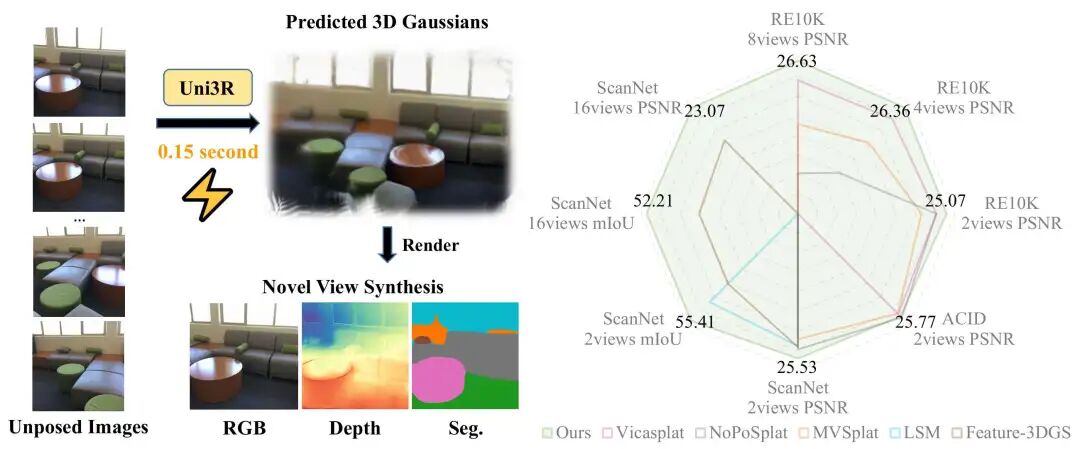

论文题目:Uni3R: Unified 3D Reconstruction and Semantic Understanding via Generalizable Gaussian Splatting from Unposed Multi-View Images

-

论文链接:https://arxiv.org/abs/2508.03643

-

项目主页:https://horizonrobotics.github.io/robot_lab/uni3R

现有3D场景重建方案,普遍面临任务表征解耦与多视图扩展受限两大局限。一方面,几何重建与语义理解通常被独立建模,且高度依赖耗时的逐场景优化,直接限制了系统的泛化能力;另一方面,现有框架多局限于双视图输入,扩展至多视图时需进行高计算成本的逐对特征匹配,常导致跨视图几何不一致。为解决上述计算冗余与表征割裂问题,本文提出了一种基于通用3D Gaussian Splatting的前馈式3D感知底座Uni3R。

Uni3R系统仅需无姿态的多视图纯视觉输入,即可直接生成融合几何结构、外观表征与开放词汇语义的3D隐式表示。架构设计上,模型采用跨视图Transformer融合机制,通过交替执行帧内自注意力与帧间交叉注意力,在无相机姿态先验的条件下,实现了对任意数量视图信息的高效整合。针对纯渲染监督易引发的几何坍塌问题,框架引入无标注几何先验以约束高斯基元的空间分布,从而在零额外几何标注的前提下,显著提升了训练稳定性与深度预测精度。依托该统一表征空间,Uni3R仅需单次前向传播,即可并发执行高保真新视角合成、开放词汇3D语义分割与深度预测三项核心任务。此外,实验表明,多任务统一表征机制不仅大幅削减了底层计算冗余,更在几何重建、视角渲染与语义理解之间确立了显著的协同增益。

定量实验表明,Uni3R彻底摒弃了逐场景优化与外部姿态估计依赖,单场景整体重建耗时仅约0.16秒。在ScanNet数据集上,其开放词汇语义分割精度达到55.84 mIoU,新视图合成质量达到25.53 PSNR;在RE10K数据集上,新视图合成质量达25.07 PSNR。整体量化指标均优于PixelSplat与LSM等主流框架,为自动驾驶与机器人数字孪生提供了高效、可扩展的实时3D场景感知方案。

几何一致视觉世界模型 突破机器人操作泛化边界

-

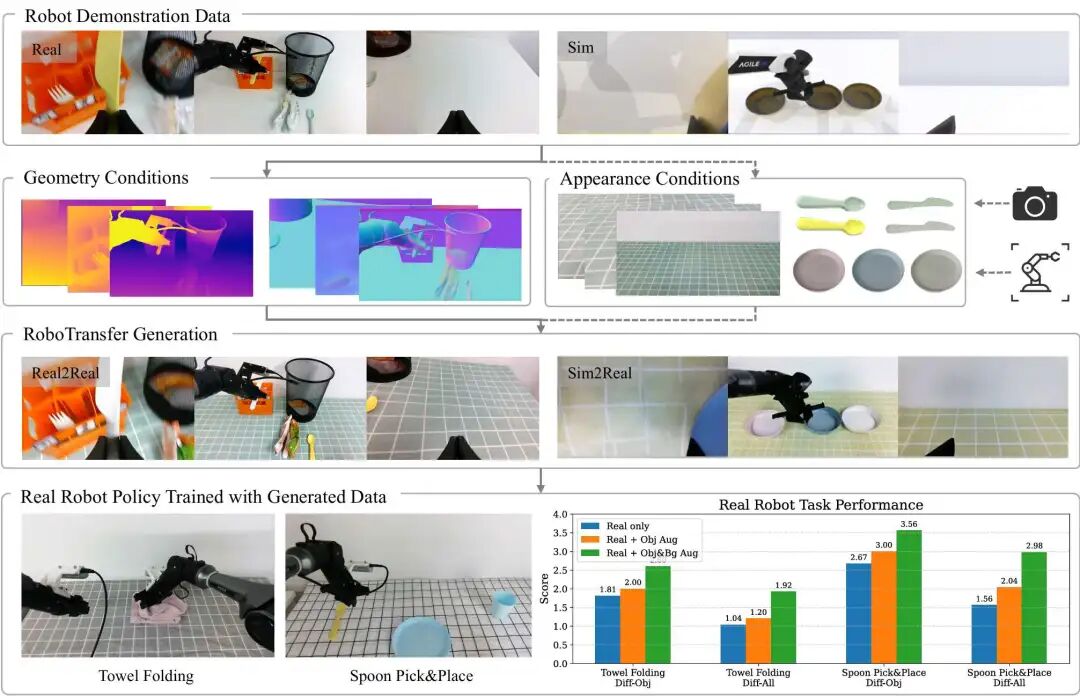

论文题目:RoboTransfer: Controllable Geometry-Consistent Video Diffusion for Manipulation Policy Transfer

-

论文链接:https://arxiv.org/abs/2505.23171

-

项目主页:https://horizonrobotics.github.io/robot_lab/robotransfer

在机器人操作领域,模仿学习是推动具身智能发展的关键路径,但高度依赖大规模、高质量的真实演示数据,面临高昂采集成本与效率瓶颈。仿真器虽提供了低成本数据生成方案,但显著的“模拟到现实” (Sim2Real) 鸿沟,制约了仿真数据训练策略的泛化能力与落地应用。

我们提出RoboTransfer——基于扩散模型的视频生成框架,旨在合成高保真且符合物理规律的机器人操作演示数据。该框架创新性地融合深度-表面法向的几何约束与多视角特征建模,确保生成视频具备高度几何一致性与真实感。通过拆分控制条件设计,实现对操作场景元素(如背景替换、物体外观)的精细控制。结合物理仿真器重构空问布局与交互状态,实现多样化、可拓展的高保真数据合成。

RoboTransfer通过数据驱动的生成式AI技术,建立机器人操作数据合成新范式,提供高质量、可扩展的演示数据,助力具身智能突破通用性与泛化性边界。实验结果表明,RoboTransfer能够生成具有高几何一致性和视觉质量的多视角视频序列。此外,使用RoboTransfer合成数据训练的机器人视觉策略模型,在标准测试任务中表现出显著提升的性能:在更换前景物体的场景下取得了33.3%的成功率相对提升,在更具挑战性的场景下(同时更换前景背景)更是达到了251%的显著提升。

打破3D重建与生成边界 原位补全构建单图3D场景生成新范式

-

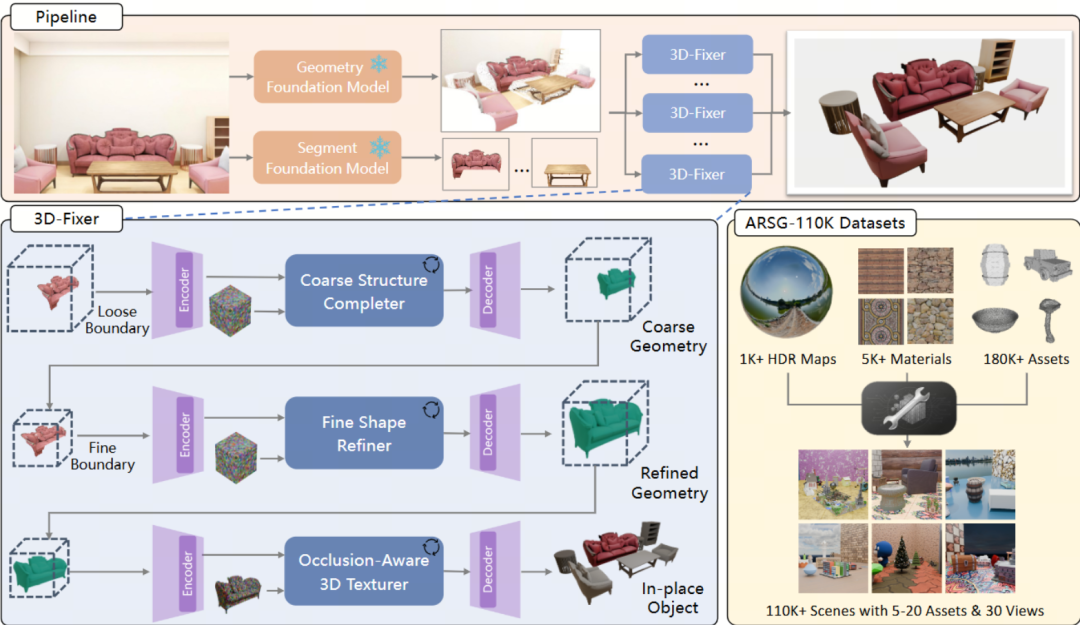

论文题目:3D-Fixer: Coarse-to-Fine In-place Completion for 3D Scenes from a Single Image

-

项目主页:https://zx-yin.github.io/3dfixer

-

代码链接:https://github.com/HorizonRobotics/3D-Fixer

基于单张图像生成3D场景,是构建机器人与具身智能数字孪生环境的关键技术 。现有方案在处理复杂场景时,常面临几何重建不完整与姿态对齐易出错的局限 ;此外,高质量场景级训练数据的稀缺,也直接限制了现有模型的泛化能力 。为此,研究团队提出了3D-Fixer技术框架,引入了“原位补全 (In-place Completion) ”范式 。该范式摒弃了传统的显式姿态对齐流程。其核心机制是利用3D基础模型,提取场景中观测到的残缺几何信息作为空间锚点,直接在原位进行3D生成与几何补全。这一设计在维持全局布局一致性的同时,兼顾了空间定位的准确度与生成物体的完整度,从而有效规避了传统迭代对齐与位姿优化过程中固有的误差累积与结构错位问题。

模型结构上,3D-Fixer通过引入 由粗到精 (Coarse-to-Fine) 的生成策略与遮挡鲁棒特征对齐 (Occlusion-Robust Feature Alignment) 机制,将预训练的物体生成先验与真实场景中的几何观测信息进行深度融合,使模型能够在存在遮挡的情况下仍然稳定推断场景结构,并有效缓解遮挡区域边界模糊的问题。与此同时,为解决高质量场景级训练数据长期稀缺的瓶颈,团队构建并开源了目前规模最大的组合式场景数据集ARSG-110K,其中包含超过11万个程序化生成的复杂场景配置以及300万张带有高保真三维标注的图像数据对。

实验结果表明,3D-Fixer在保持前馈推理高效性的同时,实现了当前领先水平的几何重建精度,为机器人与具身智能系统提供了一种高保真、具备良好泛化能力的三维场景生成新基准,并为构建大规模可交互数字孪生环境提供了重要技术支撑。

自动驾驶之心

求点赞

求分享

求喜欢

更多推荐

已为社区贡献167条内容

已为社区贡献167条内容

所有评论(0)