【AI大模型前沿】千寻智能Spirit-v1.5:开启具身智能新纪元,助力机器人迈向真实世界

Spirit-v1.5是由千寻智能团队开发的一款具身智能模型,采用Vision-Language-Action(VLA)统一建模框架,将视觉感知、语言理解与动作生成整合在同一决策流程中。该模型在多任务连续执行、复杂指令拆解以及跨构型迁移等维度表现出色,尤其在真实机器人任务中展现出强大的泛化能力和稳定性。

系列篇章💥

目录

前言

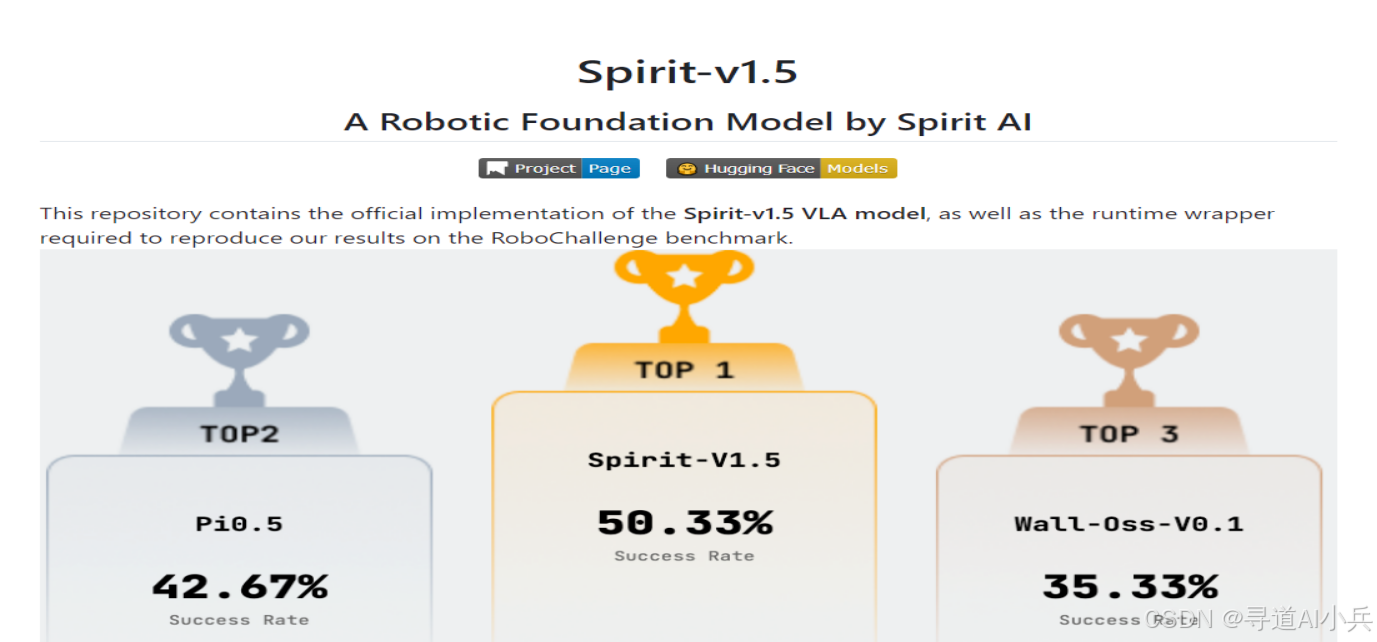

在人工智能领域,具身智能的发展正逐渐成为研究热点。千寻智能团队推出的Spirit-v1.5模型,凭借其卓越的性能和创新的技术架构,在RoboChallenge评测中登顶,成为具身智能领域的新标杆。本文将深入探讨Spirit-v1.5的核心功能、技术架构、应用场景以及快速部署实践,为技术探索者提供全面的参考。

一、项目概述

Spirit-v1.5是由千寻智能团队开发的一款具身智能模型,采用Vision-Language-Action(VLA)统一建模框架,将视觉感知、语言理解与动作生成整合在同一决策流程中。该模型在多任务连续执行、复杂指令拆解以及跨构型迁移等维度表现出色,尤其在真实机器人任务中展现出强大的泛化能力和稳定性。

二、核心功能

(一)多任务连续执行

Spirit-v1.5能够高效处理多任务连续操作,例如在复杂场景中完成一系列动作,如抓取、移动、插入等。这种能力使其在真实世界的应用中更具优势。

(二)复杂指令拆解

模型能够理解并拆解复杂的语言指令,将其转化为具体的动作序列,从而精准执行。例如,在插花任务中,Spirit-v1.5可以准确理解“将花插入花瓶并保持竖直”的指令。

(三)跨构型迁移

Spirit-v1.5在不同机器人构型之间具有良好的迁移能力,能够快速适应新环境和新任务。这种能力在多构型机器人应用场景中尤为重要。

三、技术揭秘

(一)VLA统一建模框架

Spirit-v1.5采用Vision-Language-Action(VLA)统一建模框架,将视觉感知、语言理解与动作生成整合在同一决策流程中,减少了多模块串联带来的信息损耗。这种架构设计使得模型在长时序任务中表现出更高的稳定性。

(二)多样化数据采集策略

与传统依赖“干净”演示数据的训练方法不同,Spirit-v1.5引入了开放式、多样化的数据采集范式。数据采集不再严格限定任务脚本,而是以“完成有意义目标”为导向,允许操作过程中自然串联多个子任务与原子技能。这种策略使模型在训练阶段接触到更接近真实世界的复杂性,包括遮挡、失败恢复以及任务之间的自然过渡。

(三)强化学习与自监督混合训练

Spirit-v1.5结合了强化学习和自监督学习方法,通过模拟-实机转移策略,进一步提升了模型的鲁棒性和泛化能力。这种混合训练方式不仅提高了模型的成功率,还减少了对计算资源的需求。

四、应用场景

(一)工业自动化

在工业领域,Spirit-v1.5可用于复杂装配任务,如电子设备组装。其多任务处理能力使其能够高效完成连续操作,如抓取零部件、精准安装等。复杂指令拆解功能让模型能理解多步骤指令,提高生产效率和质量,降低人工干预需求,尤其适用于高精度、重复性任务。

(二)服务机器人

在服务行业,如酒店、餐厅,Spirit-v1.5可执行物品递送、清洁等任务。其泛化能力强,能快速适应不同环境和任务需求。例如,在酒店场景中,机器人可准确理解“将物品送到指定房间”的指令,自主导航并完成任务,提升服务效率和用户体验。

(三)医疗辅助

在医疗场景中,Spirit-v1.5可用于辅助手术操作或康复训练。模型的精准动作控制和稳定性使其能够执行精细的手术辅助任务,如器械传递、伤口缝合等。此外,在康复训练中,可协助患者完成康复动作,实时调整动作幅度和力度,保障训练效果和安全性。

(四)教育与研究

在教育领域,Spirit-v1.5可作为教学工具,帮助学生理解机器人编程和人工智能原理。通过实际操作和任务模拟,学生能更好地掌握复杂指令处理和多任务执行等概念。在研究中,其开源特性为科研人员提供了宝贵的实验平台,助力具身智能技术的进一步探索。

(五)物流与仓储

在物流和仓储环境中,Spirit-v1.5可用于货物分拣、搬运等任务。其强大的视觉感知和动作规划能力使其能够快速识别货物、规划最优路径并完成搬运。模型的跨构型迁移能力使其能够适应不同类型的机器人和仓储布局,提高物流效率。

(六)家庭服务

在家庭环境中,Spirit-v1.5可承担家务劳动,如打扫卫生、整理物品等。其自然语言理解能力让家庭成员能通过简单指令控制机器人,如“请清理客厅地板”。模型的稳定性和泛化能力使其能够在复杂家庭环境中灵活操作,提升生活便利性。

五、快速使用

(一)环境准备

- 硬件要求:建议使用NVIDIA A100 80GB GPU或类似配置。

- 软件要求:Python 3.11及以上版本。

- 依赖安装:

- 使用

uv工具(推荐):uv sync source .venv/bin/activate - 使用

pip:python -m venv .venv source .venv/bin/activate pip install -r requirements.txt

- 使用

(二)模型下载

Spirit-v1.5的基础模型和针对特定任务的微调模型可通过Hugging Face下载:

基础模型[Spirit-v1.5 Base Model]:https://huggingface.co/Spirit-AI-robotics/Spirit-v1.5

微调模型(例如:移动物体到盒子中[Spirit-v1.5-move-objects-into-box]):https://huggingface.co/Spirit-AI-robotics/Spirit-v1.5-for-RoboChallenge-move-objects-into-box

(三)代码部署

-

目录结构:

model/:包含模型架构代码(如modeling_spirit_vla.py)。robochallenge/:包含运行RoboChallenge任务所需的代码。scripts/:包含启动脚本run_robochallenge.sh。

-

运行RoboChallenge任务:

-

使用

scripts/run_robochallenge.sh脚本启动任务。 -

配置环境变量:

export TASK_NAME=move_objects_into_box export ROBOCHALLENGE_JOB_ID=your_job_collection_id export USER_TOKEN=your_user_token export CKPT_PATH=/path/to/your_checkpoint_dir export USED_CHUNK_SIZE=60TASK_NAME:任务名称,需与robochallenge/runner/task_info.py中定义的任务一致。ROBOCHALLENGE_JOB_ID:作业集合的唯一ID。USER_TOKEN:用户认证令牌。CKPT_PATH:包含model.safetensors文件的目录。USED_CHUNK_SIZE:动作块大小,默认为60。

-

执行脚本:

./scripts/run_robochallenge.sh

-

六、结语

Spirit-v1.5的出现为具身智能领域带来了新的突破。其创新的技术架构和多样化的数据采集策略使其在真实世界的应用中展现出强大的泛化能力和稳定性。通过开源模型权重和推理代码,千寻智能为研究者和开发者提供了宝贵的资源。我们期待更多基于Spirit-v1.5的创新应用,推动具身智能技术的进一步发展。

项目地址

- 技术博客:https://www.spirit-ai.com/en/blog/spirit-v1-5

- 核心代码开源地址:https://github.com/Spirit-AI-Team/spirit-v1.5

- 模型开源地址:https://huggingface.co/Spirit-AI-robotics/Spirit-v1.5

🎯🔖更多专栏系列文章:AI大模型提示工程完全指南、AI大模型探索之路(零基础入门)、AI大模型预训练微调进阶、AI大模型开源精选实践、AI大模型RAG应用探索实践🔥🔥🔥 其他专栏可以查看博客主页📑

😎 作者介绍:资深程序老猿,从业10年+、互联网系统架构师,目前专注于AIGC的探索(CSDN博客之星|AIGC领域优质创作者)

📖专属社群:欢迎关注【小兵的AI视界】公众号或扫描下方👇二维码,回复‘入群’ 即刻上车,获取邀请链接。

💘领取三大专属福利:1️⃣免费赠送AI+编程📚500本,2️⃣AI技术教程副业资料1套,3️⃣DeepSeek资料教程1套🔥(限前500人)

如果文章内容对您有所触动,别忘了点赞、⭐关注,收藏!加入我们,一起携手同行AI的探索之旅,开启智能时代的大门!

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)