【世界模型】Matrix-game 2.0: An open-source real-time and streaming interactive world model

Matrix-Game 2.0是一个开源的实时流式交互世界模型,通过少步自回归扩散实现分钟级高质量视频生成。针对现有交互世界模型实时性差的问题,该框架提出三大创新:(1)基于虚幻引擎和GTA5的可扩展数据生成管道,支持1200小时带精确交互标注的视频采集;(2)动作注入模块,将键盘鼠标输入作为帧级条件;(3)基于因果架构的少步蒸馏方法,实现25FPS的实时生成。实验表明,该系统能在多种场景下保持长

标题:Matrix-Game 2.0:一个开源的实时流式交互世界模型

原文链接:https://arxiv.org/pdf/2508.13009

源码链接:https://matrix-game-v2.github.io

摘要

近年来,交互式视频生成领域的进展已证明,扩散模型通过捕捉复杂的物理动力学和交互行为,具备作为世界模型的潜力。然而,现有的交互世界模型依赖双向注意力机制和冗长的推理步骤,严重限制了实时性能。因此,它们难以模拟现实世界的动态——在现实世界中,结果必须基于历史上下文和当前动作进行即时更新。为解决这一问题,我们提出了Matrix-Game 2.0,这是一个通过少步自回归扩散实时生成长视频的交互世界模型。我们的框架包含三个关键组件:(1)一个基于虚幻引擎(Unreal Engine)和GTA5环境的可扩展数据生成管道,能够高效生成大量(约1200小时)带有多样化交互标注的视频数据;(2)一个动作注入模块,支持将帧级别的鼠标和键盘输入作为交互条件;(3)一种基于因果架构的少步蒸馏方法,用于实时流式视频生成。Matrix-Game 2.0能够以25 FPS的超高速率,在多种场景下生成高质量的分钟级视频。我们开源了模型权重和代码库,以推动交互世界建模领域的研究进展。

在双向 / 全序列扩散模型中,模型的注意力层在时间上是“全局”的,去噪步骤把整个1:N 帧的表示一起处理、互相影响——因此假设在推理要得到第 2 帧的高质量结果时,模型实际上会在内部利用第 1、3、4…等帧的信息(或者在推理时需要同时处理这些帧)。论文明确指出这种设计会导致“生成单帧需要处理整个视频”,从而导致高延迟与算力/内存二次放大问题。

1 引言

世界模型[2,23,31]因其具备理解现实世界交互并预测未来状态的能力[47],受到了广泛关注。通过使智能体能够感知周围环境并对动作做出响应,这些模型降低了现实世界试验的成本,并促进了交互仿真的发展。因此,世界模型在游戏引擎[9,12,42]、自动驾驶[17]和空间智能[2,3,29,46]等领域展现出巨大的应用前景。

近年来,视频生成模型[4,21,26,40,43]取得了显著进展,能够从大规模现实世界数据集中学习知识,涵盖从物理定律到交互场景等多个方面。这证明了它们作为世界模型的巨大潜力。在该领域的众多研究方向中,交互式长视频生成[5,6]因其实际应用价值变得日益重要——这类任务要求模型响应连续的用户输入,实时生成长视频。具体而言,当以相机运动、键盘输入等用户动作作为条件时,模型需因果式地生成帧,以支持实时用户交互。

尽管交互式视频生成已取得令人瞩目的进展,但现有方法仍面临若干重大挑战:

- 由于收集成本高、难度大,缺乏用于训练的大规模、高质量且带有丰富标注(如精确动作和相机动态)的交互式视频数据集。

- 双向视频扩散模型[23,27,57]存在延迟问题,生成单帧需要处理整个视频。这使得它们不适用于实时流式应用——这类应用要求模型能够适应动态的用户指令并实时生成帧。计算和内存需求随帧长呈二次方缩放,再加上大量的去噪迭代次数,导致长视频生成不仅计算密集,而且经济上不可行。

- 现有的自回归视频扩散模型[9,19,40]存在严重的误差累积问题。虽然这些模型基于前一帧生成下一帧,但在生成过程中往往会出现误差累积,导致视频质量随时间下降。

为解决实时交互式生成中的这些关键挑战,我们提出了Matrix-Game 2.0——一个专门设计用于同时实现实时性能和在多种场景下稳健泛化的新型框架。首先,我们的技术核心是一个集成了动作控制模块的视频扩散Transformer,通过基于Self-Forcing[18]的技术将其蒸馏为因果少步自回归模型。该架构通过高效的KV缓存机制支持训练和推理,在单个H100 GPU上实现25 FPS的生成速度,同时保持分钟级的时间一致性和精确的动作可控性——即使在训练分布之外的复杂真实场景中也能表现良好。

我们的另一项创新赋予了模型强大的泛化能力:一个全面的数据生成管道,解决了交互式训练数据中的根本性限制。该管道基于虚幻引擎构建,包括用于提升数据多样性的基于导航网格的路径规划系统,以及用于精确相机控制的四元数精度优化模块。此外,针对《侠盗猎车手5》(GTA5)环境,我们通过Script Hook集成开发了一个数据记录系统,能够同步捕获视觉内容和相应的用户交互。这些组件共同生成了带有帧级别标注的大规模数据集,满足了两个关键需求:(1)视觉内容与控制信号的精确对齐;(2)对游戏内动态交互的有效建模。

通过同时攻克效率和可控性两大挑战,Matrix-Game 2.0为世界建模领域带来了重大突破,其引入的高效框架专为实时仿真和交互而设计。为支持该领域的持续发展,我们将开源预训练模型的代码和权重。

2 相关工作

2.1 可控视频生成

随着扩散模型[16,36,38]的快速发展,视频视觉内容生成领域取得了显著进展[4,14,25,41,50,58,60]。最新的方法大多转向双向扩散Transformer[30]和自回归模型[9,19],使现代视频扩散模型能够合成高质量、时间连贯且更长的视频。

视频生成技术的这一快速发展[1,28,29,48]进一步推动了世界模型的发展——这类模型利用视频扩散技术[7,18,53],隐式学习物理定律、物体动力学和因果关系,以实现复杂环境仿真。

可控视频生成是世界仿真的核心组成部分。通常,控制信号涵盖多种模态,可分为场景可控性和动作可控性两类。已有大量研究探索了场景可控性,例如文献[14,21,34,44]利用文本、图像或3D场景先验来调控生成视频中的场景。除场景控制外,通过相机角度[49]或轨迹[15,45]实现的动作可控性也已成为重要研究方向。这些研究在提升生成视频的视觉质量和可控性方面取得了良好进展。部分基于世界模型的方法[12,13,29,54,57]进一步支持场景和动作双重可控性。然而,受限于计算资源和视频长度,大多数现有模型仍难以实现实时视频生成。

2.2 长上下文视频生成

由于长视频训练数据有限且计算成本高昂,当前的视频生成模型通常只能生成≤5秒的视频。现有的长上下文视频生成方法大致可分为两类:多段短视频拼接法和自回归生成法。对于多段视频生成,一种简单有效的方法是生成多个固定长度的重叠片段[10,32,57]。

另有部分研究[51,59]采用两阶段管道,先生成关键帧,再进行帧插值。相比之下,自回归模型在变长视频生成方面具有天然优势。例如,Diffusion Forcing[7]、CausVid[53]和Self-Forcing[18]等方法将自回归建模与扩散技术相结合,在长视频合成中取得了良好效果。然而,这些方法大多局限于传统的文本到视频(T2V)和图像到视频(I2V)任务,长交互式视频生成这一挑战仍未得到充分探索。

2.3 实时视频生成

目前已有多种方法可实现实时视频生成。主要方法包括提高变分自编码器(VAE)的压缩比、通过知识蒸馏减少扩散模型的采样步骤,或结合KV缓存与因果Transformer自回归推断下一帧。LTX-Video[14]通过优化VAE压缩比并应用模型蒸馏技术[37,52,56],在H100 GPU上实现了生成时间短于视频时长的效果。Next-Frame Diffusion[11]、Self-Forcing[18]、CausVid[53]和Oasis[12]等研究则利用自回归模型的特性,结合知识蒸馏,实现了高效的少步生成。尽管这些研究实现了实时视频生成,但大多数无法支持实时交互。Oasis虽能支持实时交互,但在长视频推断过程中视觉质量会快速下降。在本研究中,我们遵循Self-Forcing[18]的训练范式,实现少步推断,不仅能快速生成长视频,还能保持稳定一致的帧质量。

3 数据管道开发

我们设计并实现了全面的数据生成管道,以支持Matrix-Game 2.0的大规模训练。具体而言,我们的工作解决了两个关键挑战:(1)生成与键盘和相机信号标注精确对齐的游戏视频数据;(2)实现由碰撞感知导航规则和强化学习训练智能体驱动的交互式视频捕获机制,以更好地建模游戏内动态交互。为满足实际部署需求,我们开发并整理了一个多样化的数据集生成管道,涵盖来自虚幻引擎和GTA5仿真环境的静态和动态场景。

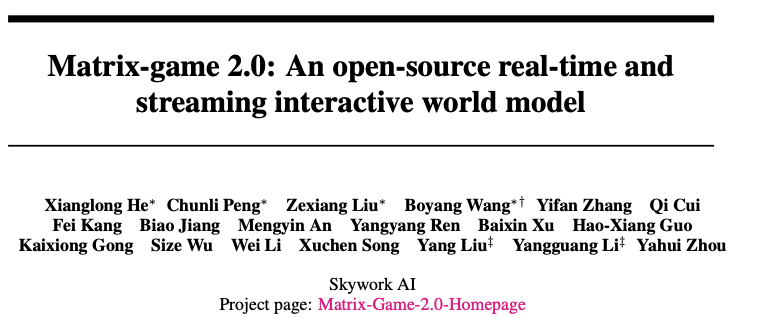

图3:基于虚幻引擎的数据生成管道概述

虚幻引擎:用于自建、可控的仿真世界

GTA5:利用其高真实度、开放世界作为补充数据源

3.1 基于虚幻引擎的数据生成

高性能交互式视频生成模型的开发需要大规模数据集,这类数据集需包含精确同步的视觉内容和控制信号(如精确对齐的键盘输入和相机参数)。现有数据集往往缺乏游戏画面与对应输入之间的精确时间对齐,而我们基于虚幻引擎的管道通过受控合成数据生成,系统性地解决了这一问题。虚幻引擎的精确环境控制和确定性渲染特性,使其特别适合生成具有保证标注准确性的可扩展多模态训练数据。

如图3所示,我们基于虚幻引擎的数据管道以导航网格和3D场景为输入。系统随后采用自动移动和相机控制模块,模拟智能体导航和动态视角转换。最后,通过集成的MP4编码器和CSV生成器,记录并导出生成的视觉数据和相应的动作标注。

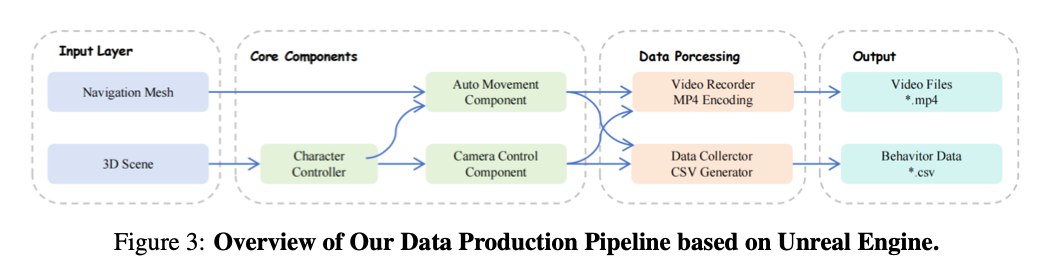

图4:导航系统示例

该系统的核心创新包括:(1)基于导航网格的路径规划模块,支持多样化轨迹生成;(2)精确的系统输入和相机控制机制,确保动作与视角的准确对齐;(3)用于高质量数据整理的结构化后处理管道。各组件的详细描述如下:

基于导航网格的路径规划系统

为提升生成训练数据的真实性和行为多样性,我们开发了先进的基于导航网格的路径规划系统,支持非玩家角色(NPC)的动态自适应移动。该系统支持实时、确定性的路径规划,这是生成可复现且高保真训练数据的关键要求。

我们的实现基于虚幻引擎原生的导航网格(NavMesh)架构,并通过定制化路径规划优化将平均查询延迟降低至2毫秒以下。此外,系统在智能体行为中引入受控随机性,使智能体在严格遵守逻辑导航约束的同时,能够产生多样化且符合上下文的移动模式。这种方法通过引入真实的智能体交互动态和移动轨迹,显著提升了训练语料库的丰富性,进而提高了下游视频生成模型的泛化能力。导航示例如图4所示,图中绿色区域为智能体可自由移动的区域,可防止智能体撞墙或被困。

强化学习增强的智能体训练

为进一步提升数据收集智能体的行为真实性和决策能力,我们在基于碰撞的导航规则基础上,集成了强化学习(RL)框架,采用近邻策略优化(PPO)[35]等典型强化学习方法。强化学习智能体的训练奖励函数结合了避撞、探索效率和轨迹多样性:

R t = α ⋅ R c o l l i s i o n + β ⋅ R e x p l o r a t i o n + γ ⋅ R d i v e r s i t y ( 1 ) R_{t}=\alpha \cdot R_{collision}+\beta \cdot R_{exploration}+\gamma \cdot R_{diversity} (1) Rt=α⋅Rcollision+β⋅Rexploration+γ⋅Rdiversity(1)

其中, R c o l l i s i o n R_{collision} Rcollision 用于惩罚碰撞事件, R e x p l o r a t i o n R_{exploration} Rexploration 奖励探索新区域的行为, R d i v e r s i t y R_{diversity} Rdiversity 鼓励多样化的移动模式。基于碰撞的规则在训练过程中作为安全约束,确保强化学习智能体在学习最优导航策略的同时,保持物理合理性。

这种混合方法结合了基于规则避撞的确定性安全性和强化学习训练行为的自适应智能,使智能体能够生成更真实、更多样的交互模式,同时保证数据收集的可靠性。

精确输入与相机控制

我们集成了虚幻引擎的增强输入(Enhanced Input)系统,能够以毫秒级精度同时捕获多个键盘输入。系统维护与渲染帧对齐的输入事件同步缓冲区,确保训练所需的输入-视觉精确同步:

I n p u t f r a m e i = ( { k 1 , k 2 , . . . , k n } , t i m e s t a m p i ) ( 2 ) Input _{frame _{i}}=\left(\left\{k_{1}, k_{2}, ..., k_{n}\right\}, timestamp _{i}\right) \quad (2) Inputframei=({k1,k2,...,kn},timestampi)(2)

其中,每个输入状态 k j k_{j} kj 代表与第 i i i 帧对齐的特定按键按下或释放事件。为消除相机旋转计算中0.2%的关键误差率,我们通过在中间计算中使用双精度算术,实现了四元数精度优化。该优化将旋转误差降低到可忽略的水平。

数据整理

我们开发了基于OpenCV的视频帧过滤算法,用于检测并消除时间冗余帧,从而提升数据效率。此外,我们引入了基于速度的验证机制,以识别并排除速度为零或负的无效样本——这类样本通常表示静止或物理上不合理的运动状态:

v a l i d i t y = { 1 i f ∥ v ⃗ ∥ > ϵ 0 o t h e r w i s e validity = \begin{cases}1 & if \| \vec{v}\| >\epsilon \\ 0 & otherwise \end{cases} validity={10if∥v∥>ϵotherwise

其中, v ⃗ \vec{v} v 表示速度向量, ϵ \epsilon ϵ 是一个小的正阈值,用于应对浮点数精度问题。该准则确保仅保留具有语义意义的运动数据用于后续模型训练。

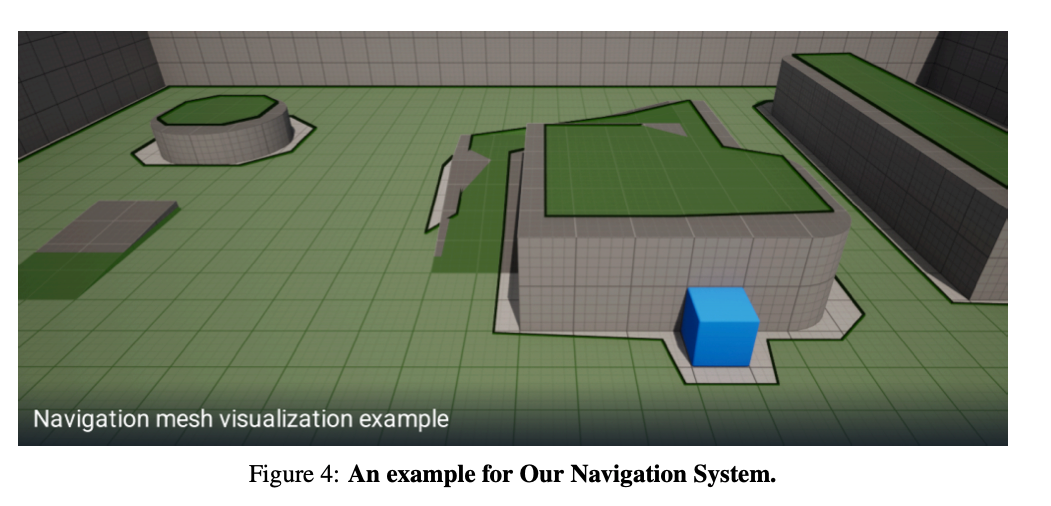

多线程管道加速

我们重新设计了数据处理管道以支持多线程执行,使单个RTX 3090 GPU能够实现双流数据生成。系统采用独立的渲染线程和共享内存池,以实现高效的资源利用。部分代表性轨迹示例如图5所示,图中绿色线段代表智能体的移动路径,即使在复杂场景中也能规划出合理路径。

图5:收集的虚幻引擎数据轨迹示例

3.2 GTA5 交互式数据记录系统

为获取富含交互的动态场景,我们通过 Script Hook 集成在 GTA5 中开发了一套全面的记录系统,能够同步捕获视觉内容和相应的用户动作。

我们利用 Script Hook V 实现了定制化插件架构,在 GTA5 环境中构建记录管道。该插件能够以帧级精度同步捕获鼠标和键盘操作,收集的每个数据项均包含 RGB 帧及对应的鼠标、键盘操作信息。

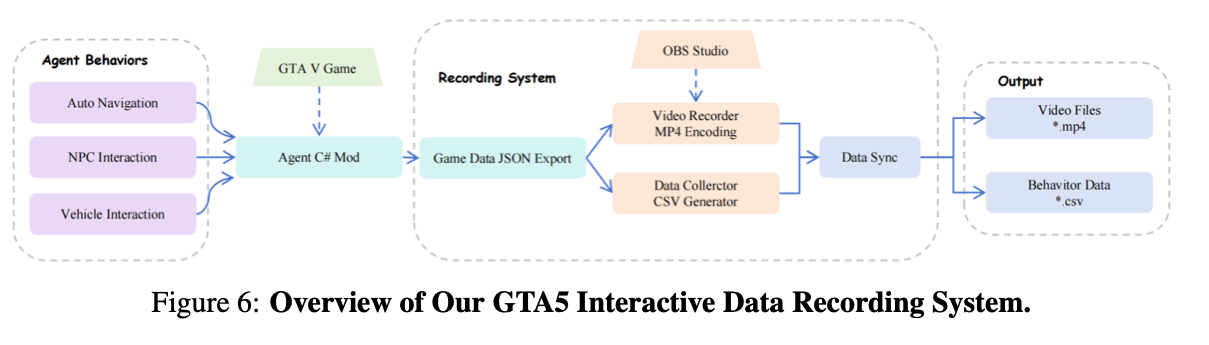

如图6所示,该系统包含三个核心组件:智能体行为(Agent Behaviors)、GTA5 游戏环境(GTA V Game Environment)和记录系统(Recording System)。智能体行为模块具备自主导航、NPC 交互和车辆交互功能,通过定制化 C# 插件集成到 GTA5 游戏中。游戏以 JSON 格式将行为数据导出至记录系统,记录系统利用 OBS Studio 进行 MP4 编码视频捕获,并通过数据收集器(Data Collector)生成 CSV 文件。同步机制确保视频帧与行为数据的时间对齐,最终输出同步的视频文件(.mp4)和行为数据集(.csv)。可选择性启用自主导航、NPC 交互、车辆交互等动态控制机制,从第一人称或第三人称视角生成交互式场景。车辆密度、NPC 数量、天气模式、时间设置等环境参数可调节,以模拟多样化动态场景,提升收集数据的多样性和真实性。具体而言,车辆密度参数可在 [0.1, 2.0] 范围内配置,NPC 密度参数的配置区间为 [0.2, 1.5]。

图6:GTA5 交互式数据记录系统概述

为在车辆导航仿真中获得最佳视角,系统通过逐帧位置更新确保相机精确对齐,在整个仿真过程中维持相对车辆的最优且稳定视角:

C a m e r a p o s i t i o n = V e h i c l e p o s i t i o n + o f f s e t × r o t a t i o n ( 4 ) Camera _{position }= Vehicle _{position }+ offset \times rotation \quad (4) Cameraposition=Vehicleposition+offset×rotation(4)

基于车辆动力学特性,系统推断并记录相应的键盘输入,生成包含速度、加速度和转向角的全面且时间对齐的交互数据。

此外,我们开发了实时系统以动态访问导航网格信息,助力智能相机定位和运动预测。该系统通过查询导航网格数据结构提取空间约束和有效通行路径,从而实现相机轨迹的优化规划。导航网格查询过程涉及实时空间数据检索和路径验证,确保相机运动被限制在可导航区域内,同时保留有效数据采集所需的最优视角。

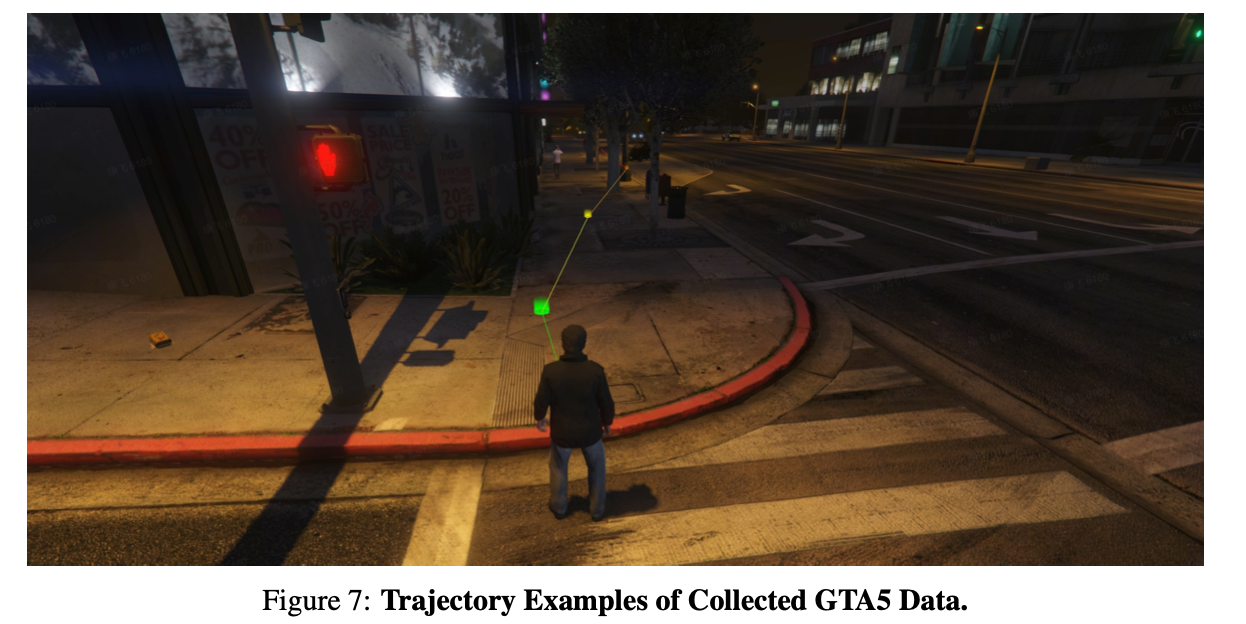

图7:收集的 GTA5 数据轨迹示例

3.3 定量数据评估

通过我们的数据整理管道,共收集了超过 120 万个视频片段,该管道在多个关键指标上表现稳健。数据整体准确率超过 99%,相机旋转精度提升了 50 倍。此外,每个 GPU 支持双并发数据流,生产效率提升一倍。代表性轨迹示例如图7所示,GTA5 游戏环境复杂多样,图中线条代表智能体的移动路径,通过合理规划路径可防止智能体碰撞或被困,有效提升数据准确性。

4 方法

本节将介绍 Matrix-Game 2.0 的整体架构和核心组件。首先,如 4.1 节详细所述,我们利用多样化收集的数据训练基础模型。随后,4.2 节将阐述蒸馏方法——该方法将基础模型转换为少步自回归扩散模型,在保持视觉质量的同时,实现长视频序列的实时生成。

4.1 基础模型架构

我们提出的 Matrix-Game 2.0 是一种新型视觉驱动世界模型框架,旨在探索无需依赖语言描述即可理解和生成世界的智能体。在现有研究中,文本引导已成为主流控制方式——例如 SORA [28]、HunyuanVideo [22] 和 Wan [43] 均利用文本描述进行生成。然而,这类方法往往引入语义先验,使生成偏向语言推理而非物理定律,从而阻碍模型掌握视觉世界的基本属性。

相比之下,Matrix-Game 2.0 摒弃所有形式的语言输入,仅专注于从图像中学习空间结构和动态模式。这种去语义化建模方法受空间智能 [46] 概念启发,强调模型能力应源于对视觉和物理定律的直观理解,而非抽象的语义框架。

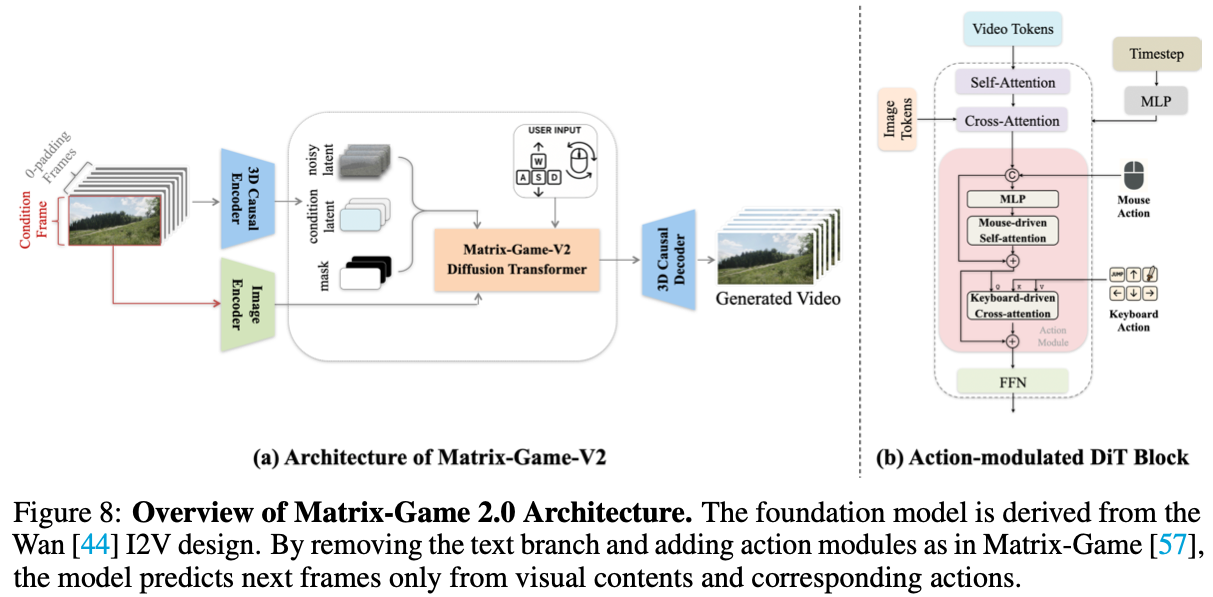

图8:Matrix-Game 2.0 架构概述。基础模型基于 Wan [44] 的 I2V 设计,通过移除文本分支并添加 Matrix-Game [57] 中的动作模块,模型仅根据视觉内容和相应动作预测下一帧。

如图8(a)所示,Matrix-Game 2.0 以单张参考图像和相应动作为输入,生成物理上合理的视频。首先采用 3D 因果变分自编码器(3D Causal VAE)[20,55] 对原始视频数据进行空间和时间维度压缩——空间维度压缩 8×8 倍,时间维度压缩 4 倍,以提升训练效率和建模能力。图像输入经 3D VAE 编码器和 CLIP 图像编码器 [33] 编码后作为条件输入。在用户提供的输入动作引导下,扩散 Transformer(DiT)生成视觉令牌序列,随后通过 3D VAE 解码器解码为视频。

为实现用户与生成内容的交互,Matrix-Game 2.0 集成了动作模块以实现可控视频生成。受 GameFactory [54] 和 Matrix-Game [57] 控制设计范式启发,我们将帧级动作信号嵌入 DiT 块中,如图8(b)所示。注入的动作信号分为两类:通过键盘输入实现的离散移动动作,以及通过鼠标移动实现的连续视角动作。具体而言,连续鼠标动作直接与输入 latent 表示拼接,经 MLP 层后传入时间自注意力层;键盘动作则通过交叉注意力层由融合特征查询,实现精确的交互可控性。与 Matrix-Game [57] 不同,我们采用旋转位置编码(Rotary Positional Encoding, RoPE)[39] 替代添加到键盘输入的正余弦嵌入(sin-cos embeddings),以支持长视频生成。

为什么键盘输入是离散移动动作,鼠标移动是连续视角动作?

为什么鼠标动作是拼接,键盘动作是交叉注意力?

4.2 实时交互式自回归视频生成

不同于 Matrix-Game [57] 采用的固定长度生成全序列扩散模型,我们开发了自回归扩散模型用于实时长视频合成。通过 Self-Forcing [18] 技术,我们将双向基础模型转换为高效的自回归变体——该技术通过以先前自生成输出而非真实标签(ground truth)为条件生成每帧,解决了暴露偏差(exposure bias)问题,显著减少了教师强制(Teacher Forcing)[19] 或扩散强制(Diffusion Forcing)[7] 方法中典型的误差累积。

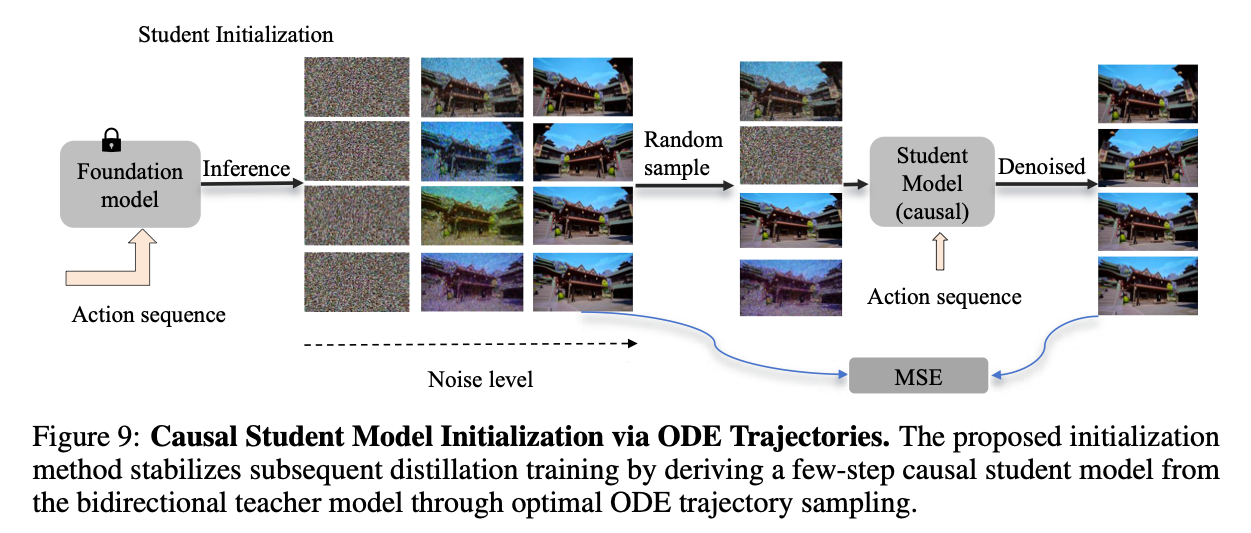

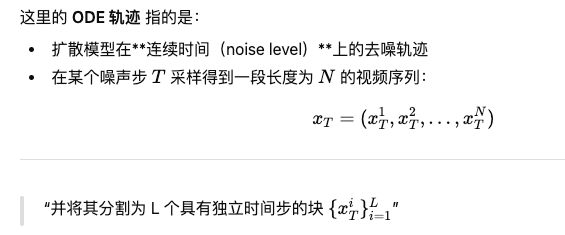

蒸馏过程包含两个关键阶段:学生模型初始化和基于分布匹配蒸馏(DMD-based)[52] 的 Self-Forcing 训练。首先,利用基础模型的权重初始化学生生成器 G ϕ G_{\phi} Gϕ,然后构建常微分方程(ODE)轨迹数据集 { x t i } i = 1 N \{x_{t}^{i}\}_{i=1}^{N} {xti}i=1N,其中 t t t 从 [0, T] 的 3 步子集中采样。训练过程中,对每个注意力层的键(keys)和值(values)施加块级因果掩码。如图9所示,首先从 ODE 轨迹中采样包含 N 帧的带噪输入序列,并将其分割为 L 个具有独立时间步的块 { x T i } i = 1 L \{x_{T}^{i}\}_{i=1}^{L} {xTi}i=1L。学生生成器以相应动作为输入,通过去噪输出与干净输出之间的回归损失进行反向传播:

L s t u d e n t = E x , t i ∥ G ϕ ( { x t i i } i = 1 L , { c i } i = 1 L , { t i } i = 1 L ) − { x 0 i } i = 1 L ∥ 2 \mathcal{L}_{student }=\mathbb{E}_{x, t^{i}}\left\| G_{\phi}\left(\left\{x_{t^{i}}^{i}\right\}_{i=1}^{L},\left\{c^{i}\right\}_{i=1}^{L},\left\{t^{i}\right\}_{i=1}^{L}\right)-\left\{x_{0}^{i}\right\}_{i=1}^{L}\right\| ^{2} Lstudent=Ex,ti

Gϕ({xtii}i=1L,{ci}i=1L,{ti}i=1L)−{x0i}i=1L

2

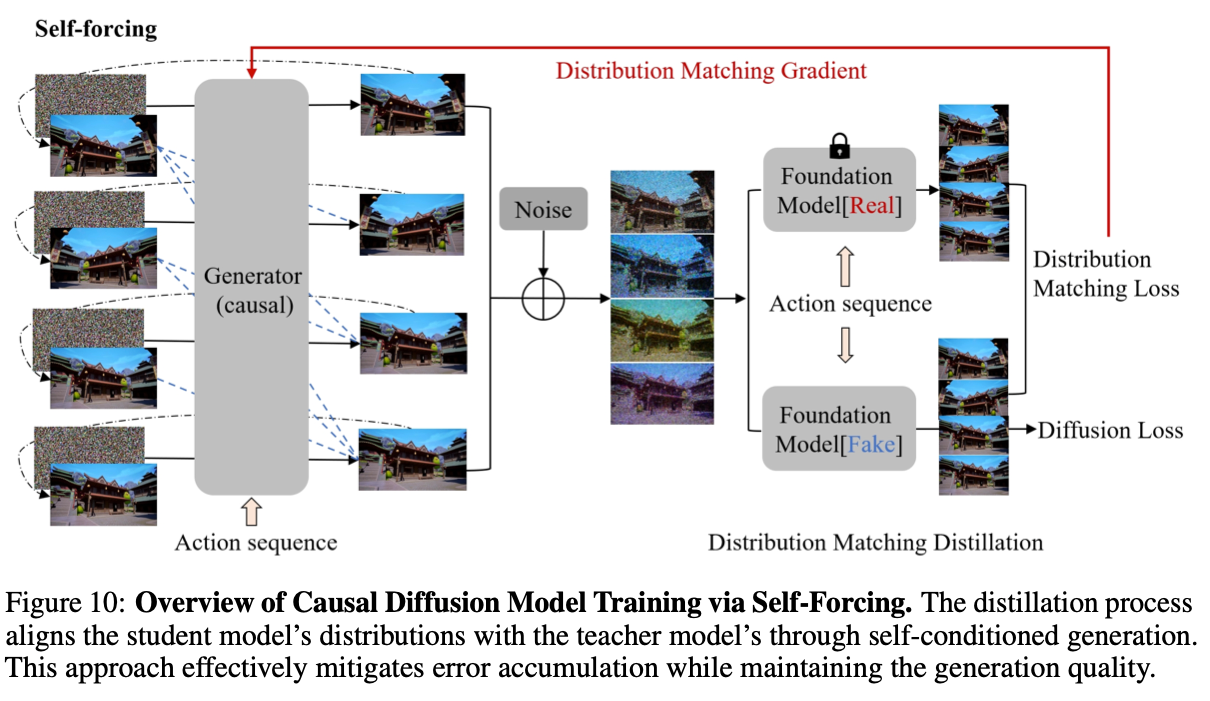

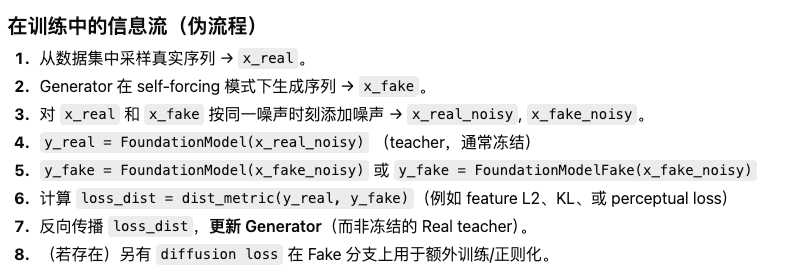

后续的 DMD 阶段(图10)通过 Self-Forcing 使学生模型的分布 p θ , t ( x t 1 : N ) p_{\theta, t}(x_{t}^{1: N}) pθ,t(xt1:N) 与教师模型的分布 p r e a l , t ( x t 1 : N ) p_{real , t}(x_{t}^{1: N}) preal,t(xt1:N) 对齐。关键在于,生成器通过最优 ODE 轨迹采样从双向教师模型中采样前序帧,而非依赖真实训练数据,从而缓解训练-推理差距(training-inference gap)及由此导致的误差累积。

图9:基于 ODE 轨迹的因果学生模型初始化。该初始化方法通过从基础模型中导出少步因果学生模型,稳定后续蒸馏训练。

图10:基于 Self-Forcing的因果扩散模型训练概述。蒸馏过程通过自条件生成使学生模型分布与教师模型分布对齐,有效缓解误差累积的同时保持生成质量。

Foundation Model[Real]:把真实/干净数据(或真实带噪样本)送进去,产生的输出/特征被当作“目标分布 / 参考”(通常是冻结的 teacher)。

Foundation Model[Fake]:把generator 生成的假样本(fake)送进去,产生的输出用于与 Real 分支对比,进而计算 distribution matching loss(该损失用于训练 generator)。

区分 Real / Fake 两条支路的唯一目的,是构造一个“可学习的对照实验”,让生成器知道:

「我生成的结果,和真实世界在 同一个老师眼里,到底差在哪里。」即:“我生成的,和真实的,在同一评价体系下差多少?”

KV 缓存机制通过维持固定长度的近期 latent 表示和动作嵌入缓存,支持高效的序列生成。我们的滚动缓存(rolling cache)实现会在超出容量时自动淘汰最旧令牌,支持无限长度生成。为解决图像到视频场景中长视频推理可能排除第一帧导致的潜在训练-推理差距,我们限制了 KV 缓存窗口大小。这迫使模型更多依赖学习到的先验知识和对输入动作的理解进行生成,同时通过在训练过程中使初始帧对后续 latent 帧不可见,提升模型稳健性。

5 实验

5.1 实验设置

实现细节

训练基础模型时,我们基于SkyReelsV2-I2V-1.3B[8]进行初始化,该模型遵循Wan 2.1[44]架构。1.3B参数版本在生成质量和计算效率之间实现了最优平衡,能够支持实时高质量生成。我们从公开的检查点中移除了文本注入模块。为稳定整个训练过程,首先对模型进行5000步微调,随后在每个DiT块中添加动作模块,最终模型总参数量达到18亿。基础模型的训练总步数为12万步,学习率设为2e-5,批量大小为256。

蒸馏阶段,首先收集4万个ODE对,对因果学生模型进行6000步微调,随后通过基于DMD的Self-Forcing进行4000步训练,学习率为6e-6。 latent帧的块大小和注意力局部大小分别设为3和6。此外,Self-Forcing是一种无数据依赖的训练方法,支持手动设计动作序列分布,相比自动脚本生成的随机动作序列,能更好地与用户输入动作对齐。

数据集

训练数据集通过第3节所述的管道生成,包含约800小时带动作标注的360p分辨率视频。数据涵盖153小时《我的世界》(Minecraft)视频数据和615小时虚幻引擎数据,每个视频片段包含57帧。对于现实世界场景,我们采用开源的Sekai数据集[24],经数据整理后获得额外85小时训练数据。由于Sekai数据集的环境导航速度和FPS与虚幻引擎场景存在差异,我们对其进行帧重采样以对齐时间动态和运动模式。为验证框架的通用性,我们进一步收集了574小时GTA驾驶数据和560小时《神庙逃亡》(Temple Run)游戏数据(含动态场景交互)用于额外微调。所有视频均调整为352×640分辨率。

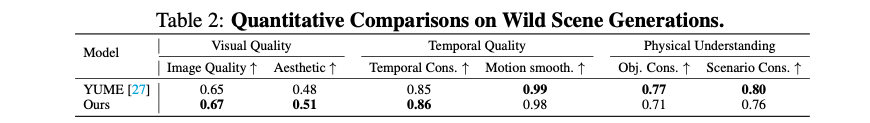

评估指标与基线模型

我们采用Matrix-Game 1.0中提出的GameWorld Score Benchmark[57]对通用实时模型进行评估。该基准提供了多维度评估框架,涵盖视觉质量、时间质量、动作可控性和物理规则理解四大核心能力。考虑到目前开源交互式世界模型的稀缺性,我们针对两个不同领域分别进行评估:《我的世界》和野生场景。《我的世界》环境中,以Oasis[12]作为主要基线模型;更复杂的野生场景生成任务中,采用YUME[27]作为基线。所有实验均使用597帧的复合动作序列,在32个《我的世界》场景和16个多样化野生场景图像上进行评估,以覆盖不同的交互条件。

5.2 生成结果

我们在多个领域对Matrix-Game 2.0与当前最先进的基线模型进行了全面的定性和定量评估,包括《我的世界》环境、野生场景的长视频生成,以及GTA驾驶场景和《神庙逃亡》游戏的生成可视化。

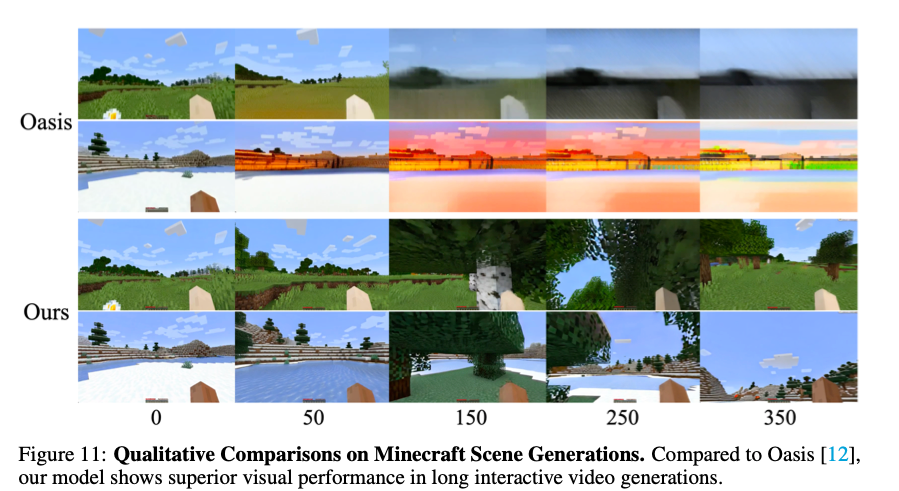

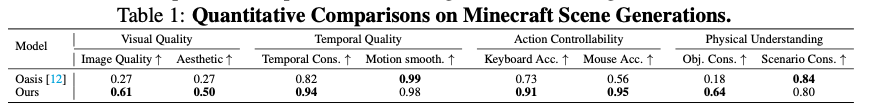

《我的世界》场景结果

图11和表1展示了Matrix-Game 2.0相对于Oasis[12]的优越性能。Oasis在生成数十帧后会出现明显的质量下降,而我们的模型在长时间生成序列中始终保持出色表现。定量指标显示,模型在大多数评估维度上均有显著提升,但在场景一致性和动作流畅度上得分略低。这是因为Oasis在崩溃后倾向于生成静态帧,从而拉高了这些特定指标的数值。

图11:《我的世界》场景生成的定性对比。与Oasis[12]相比,我们的模型在长交互式视频生成中表现出更优的视觉性能。

表1:《我的世界》场景生成的定量对比。

野生场景结果

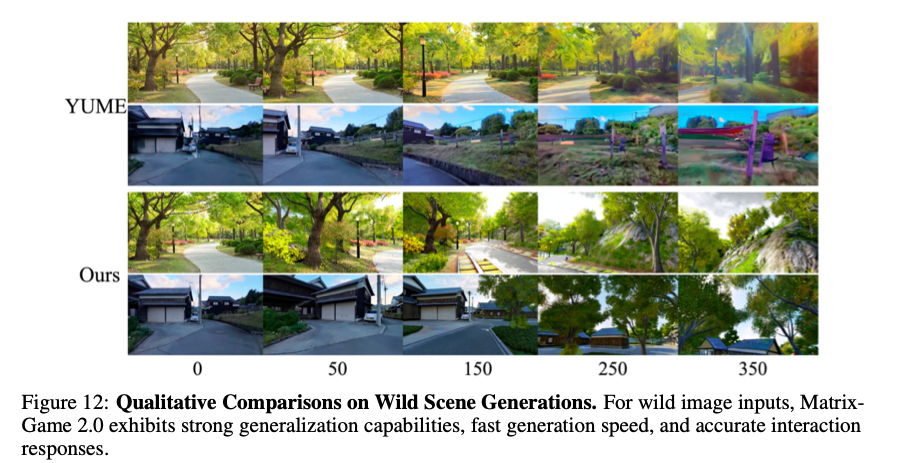

图12中与YUME[27]的对比表明,Matrix-Game 2.0在野生场景生成中具有强大的稳健性。YUME在生成数百帧后会出现明显的伪影和色彩过饱和问题,而我们的模型能够保持稳定的风格保真度。此外,YUME的生成速度较慢,难以直接应用于交互式世界建模。

图12:野生场景生成的定性对比。对于野生图像输入,Matrix-Game 2.0展现出强大的泛化能力、快速的生成速度和精准的交互响应。

表2:野生场景生成的定量对比。

表2展示了定量结果。由于GameWorld Score Benchmark中的动作可控性评估是专为《我的世界》设计的,无法直接应用于野生场景。实证结果表明,YUME在域外场景中动作控制性能显著下降,而我们的方法能够保持稳健的可控性。YUME崩溃后生成的内容往往是静态的,这也可能导致其物体一致性和场景一致性得分较高。

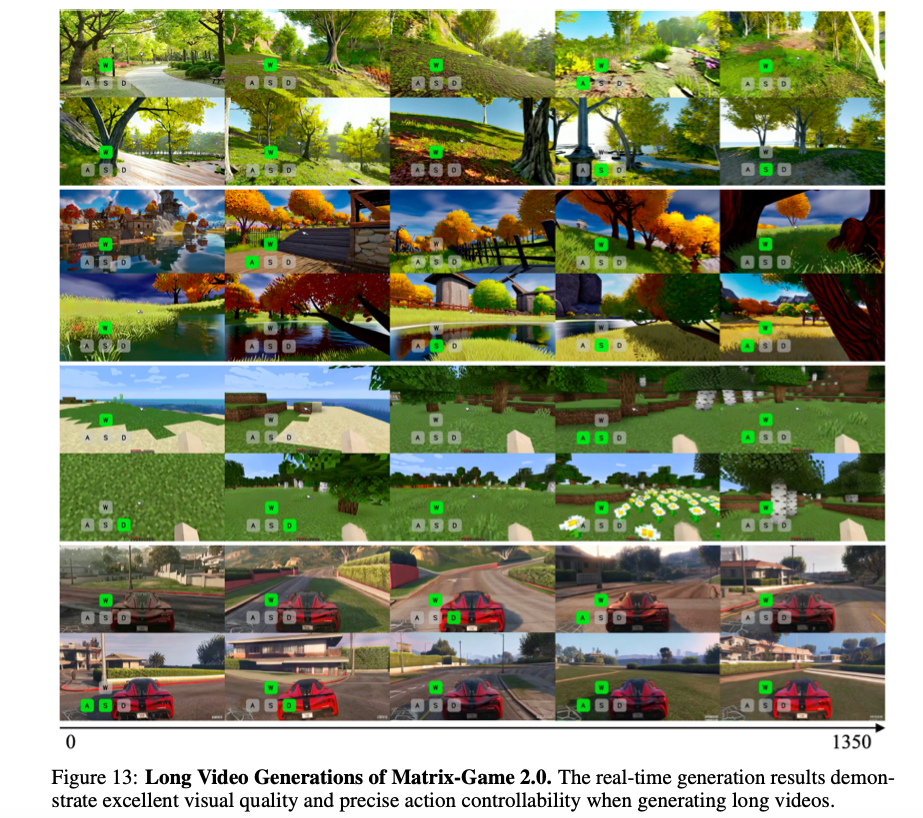

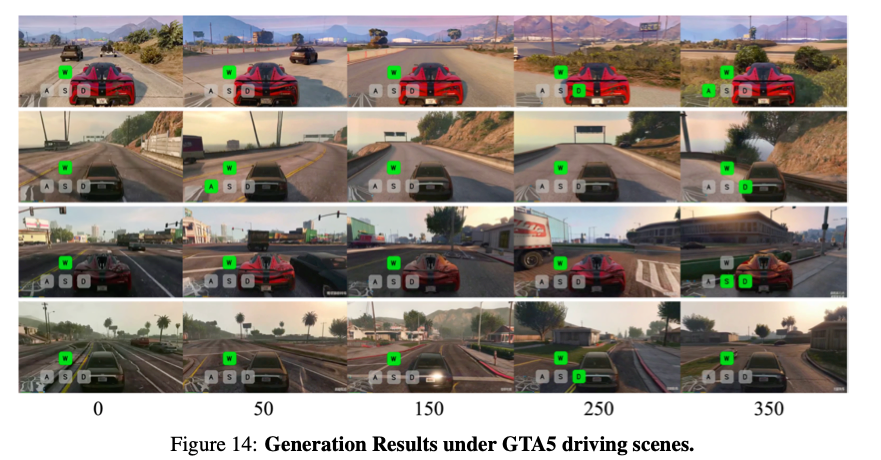

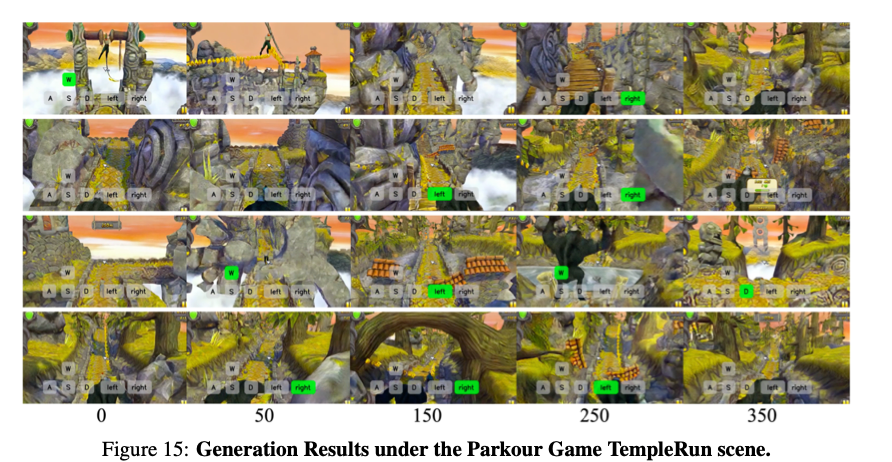

更多定性结果

图13展示了Matrix-Game 2.0出色的长视频生成能力,生成过程中质量退化极小。模型在GTA驾驶场景(图14)和《神庙逃亡》游戏(图15)等多样化场景中的表现,进一步证明了其强大的领域适应性,彰显了其作为世界建模基础框架的潜力。

图13:Matrix-Game 2.0的长视频生成结果。实时生成结果表明,模型在生成长视频时具有出色的视觉质量和精准的动作可控性。

图14:GTA5驾驶场景的生成结果。

图15:跑酷游戏《神庙逃亡》场景的生成结果。

5.3 消融实验

不同KV缓存局部大小

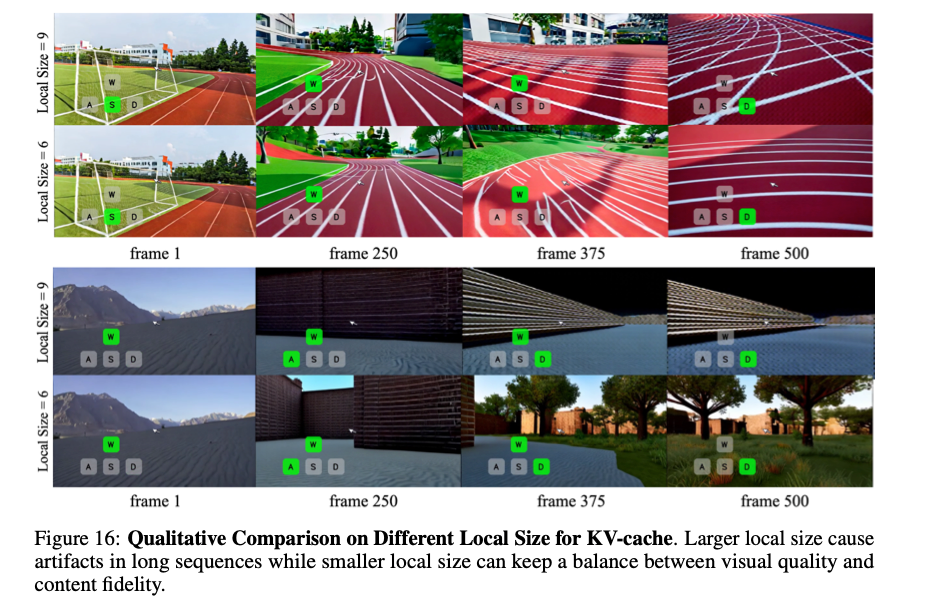

KV缓存机制在Matrix-Game 2.0的自回归生成过程中起着关键的上下文信息保持作用。我们的研究发现,缓存大小的选择存在重要权衡:虽然更大的缓存(9个latent帧)理论上能提供更丰富的历史上下文,但反而会更早出现视觉伪影(图16)。对比分析表明,6帧缓存的模型在长期生成质量上表现更优,失真和退化伪影显著减少。这一现象源于生成过程中对缓存信息的过度依赖——缓存越大,模型越倾向于依赖存储的缓存内容,而非通过自身学习能力主动修正累积误差。这会导致早期帧中的伪影通过缓存机制被进一步记忆,最终被视为有效的场景元素。实证研究表明,中等大小的缓存(6帧)能够在上下文保留和误差修正能力之间取得平衡。

图16:不同KV缓存局部大小的定性对比。较大的局部大小会导致长序列中出现伪影,而较小的局部大小能够在视觉质量和内容保真度之间保持平衡。

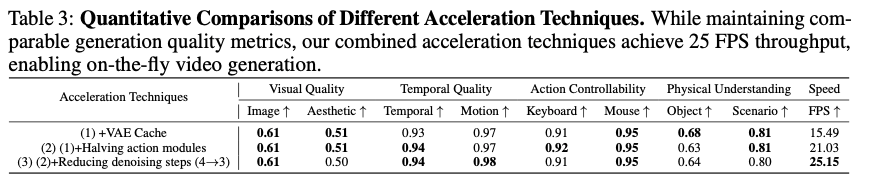

加速技术的对比分析

为实现25 FPS的实时生成,我们通过多项关键修改对扩散模型和VAE组件进行了系统性优化。首先,将高效的Wan2.1-VAE架构与缓存机制集成,显著加速了长视频序列的解码过程。其次,仅在DiT块的前半部分策略性地部署动作模块,并在蒸馏过程中将去噪步骤从4步减少到3步。定量对比结果如表3所示,这些加速策略在保持生成质量指标相当的前提下,实现了25 FPS的生成速度,达成了最优的速度-质量权衡。

表3:不同加速技术的定量对比。在保持生成质量指标相当的情况下,我们的组合加速技术实现了25 FPS的吞吐量,支持实时视频生成。

6 结论

Matrix-Game 2.0通过精心设计的数据管道和高效的训练框架,在实时交互式视频生成领域取得了重大进展。首先,我们开发了全面的数据生成管道,克服了以往交互式场景高质量训练数据获取的局限性。基于虚幻引擎的系统化管道,结合在GTA5环境中验证的视频记录框架,为大规模生成高保真动作标注视频数据树立了新标准。

其次,我们提出了自回归扩散框架,将动作条件调制与基于Self-Forcing的蒸馏相结合。该方法有效缓解了传统长视频合成中普遍存在的误差累积问题,同时保持了实时性能。通过对扩散过程和VAE架构的系统性优化,我们实现了25 FPS的生成速度,支持无缝的人机交互。

大量实验表明,Matrix-Game 2.0为交互式生成系统树立了新的基准,在视觉质量和动作可控性方面均表现出色。该模型能够在长期交互中保持时间连贯性,同时精准响应用户输入,为需要实时世界仿真的应用领域迈出了重要一步。

6.1 局限性

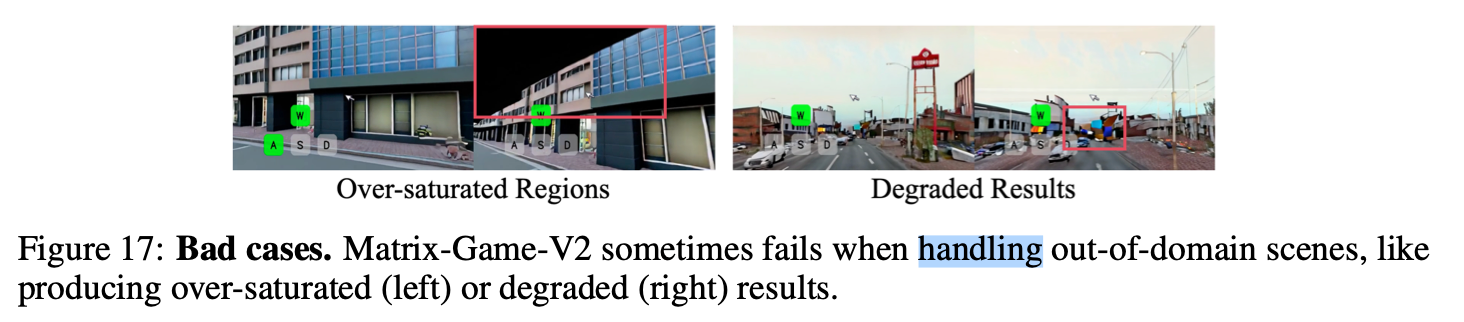

尽管表现出强大的性能,Matrix-Game 2.0仍存在若干局限性,为未来研究指明了方向。首先,模型在处理域外(OOD)场景时的泛化能力有待提升——例如,在域外场景中长时间向上移动相机或向前行进,可能会导致生成结果出现过饱和或质量退化(图17)。其次,当前352×640的输出分辨率低于最先进的视频生成模型,这些模型通常能生成更高清晰度的结果。第三,虽然自回归扩散模型支持长视频生成,但由于缺乏用于历史保存的显式记忆机制,在长视频生成过程中维持内容一致性和历史连贯性仍然具有挑战性。

图17:失败案例。Matrix-Game 2.0在处理域外场景时有时会失败,例如生成过饱和(左)或质量退化(右)的结果。

我们认为这些局限性为改进提供了明确的路径。泛化能力和分辨率问题可以通过扩展训练数据领域和模型架构缩放来解决。此外,最后一个局限性可以通过集成兼容的记忆检索机制来解决,同时不影响实时性能。这些方向将是我们未来工作的重点,旨在使交互式视频生成更适用于现实世界应用。

思考

现有方法存在的问题:

(1)交互式视频数据集缺失;

(2)双向视频扩散模型存在延迟问题,生成单帧需要处理整个视频,计算开销大;

(3)存在严重的误差累积问题。这些模型基于前一帧生成下一帧,但在生成过程中往往会出现误差累积,导致视频质量随时间下降。

文中提出的对应问题解决方法:

(1)提出一个基于虚幻引擎和GTA5环境的可扩展数据生成管道,产生大量带有多样化交互标注的视频数据;

(2)通过因果自回归架构 + 块级去噪【把长视频按时间切成短块】 + 少步蒸馏【使用强大的双向扩散模型作为 teacher,把学生模型蒸馏成 极少去噪步数(如 1–4 步),使用 ODE 轨迹 + distribution matching】;

(3)采用Self-forcing(自强)训练策略【训练时不总是用真实历史帧;而是让模型用自己生成的帧作为后续输入条件;人为制造“推理时会遇到的错误分布”】 + 分布匹配蒸馏【用强 teacher 扩散模型作为“质量裁判”;teacher 看真实视频的反应,teacher 看 student 生成视频的反应,强制 student 的生成分布贴近真实分布】

这篇工作的主要核心:实时性 + (去除文本输入,强调模型能力应源于对视觉和物理定律的直观理解,而非抽象的语义信息)

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)