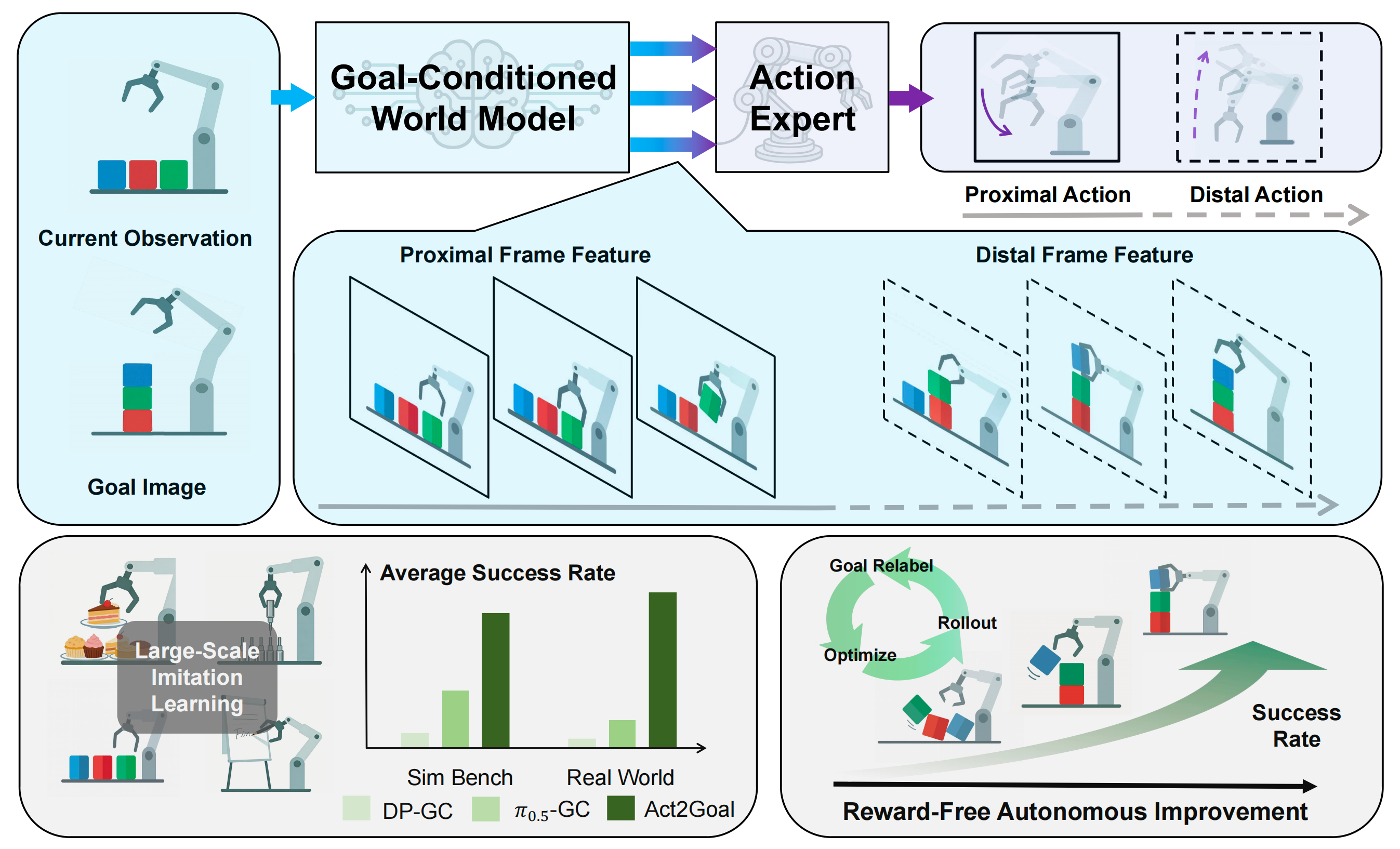

Act2Goal——基于世界模型生成未来视觉轨迹以指导低层运动控制:通过MSTH将轨迹分解为近端和远端帧,且基于HER实现无需外部奖励的在线自主改进

摘要:本文介绍了智元团队2025年底发布的Act2Goal框架,该研究将目标条件世界模型与多尺度时间哈希机制结合,解决了长时程任务中的泛化难题。通过分解视觉轨迹为近端控制帧和远端规划帧,实现了全局一致性与局部响应性的平衡。框架支持基于Hindsight Experience Replay的无监督在线改进,采用LoRA微调实现快速适应。相比传统方法,Act2Goal通过显式建模视觉动态过程,为机器人

前言

今天的新的一年2026年第一天,从2010年10月写博至今,竟然已写博15年3个月,这15年多的时间,我回顾了下每一年写博客的数量,发现最近三年真是疯狂更新,一方面解读大量论文,二方面分享我司的各种大模型实践、具身实践

之所以在过去三年如此疯狂更新,个人觉得归根结底有两个原因

- chatgpt重新唤醒了我对技术的绝对热情,比如大模型、特别是具身智能

- 过去三年,我司从教育公司先后历经大模型应用开发、具身开发

而在具身落地的过程中,技术亟待突破

一方面,需要保持对最新技术的追踪

二方面,具身智能把「个人热情和工作需要」完美的结合在了一起,既照顾了个人兴趣,又推动了公司

三方面,我十分的清楚,无论是我对论文解读,还是分享我司在具身落地方面的实践经验,都会帮助千千万万的人

如此,使得我持续更新本博客的动力 达到最高点,史无前例

过去一年,不少研究团队发布过世界模型相关的工作,新的一年第一篇解读就来介绍智元于25年年底发布的Act2Goal吧

第一部分 Act2Goal: From World Model To GeneralGoal-conditioned Policy

1.1 引言与相关工作

1.1.1 引言

如原论文所述,目标条件策略(Goal-conditioned policies,GCPs)将当前观测与目标视觉目标直接映射为动作 [1, 2, 3, 4-Goal-conditioned on-policy reinforce-ment learning]

- 尽管这些方法在短时程设定中表现良好,并展现出一定的泛化能力

5-Zero-shot robotic manipulation with pre-trained image-editing diffusion model

6-Predictive inversedynamics models are scalable learners for robotic manipulation

但在长时程任务中的性能会下降

这一局限性的产生是因为标准的 GCPs 通过直接动作预测进行决策 [7],因而缺乏对任务进展、中间可行性或长时跨度一致性的显式表征

——————

ps,说到任务进展这个话题,倒让我想到了本博客内解读过的这两个工作一个是《π∗0.6——RL微调流式VLA π0.6:先基于演示数据做离线RL预训练,再在线RL后训练(与环境自主交互,从经验数据中学习,且必要时人工干预)》,详见该文的「1.2.1 分布式价值函数训练:给 “任务进度” 精准打分」

一个是《GR-RL——首个让机器人系鞋带的VLA:先离线RL训练一个“分布式价值评估器”以做任务进度预测,后数据增强,最后在线RL》,详见该文的「1.2.1 离线RL:基于学习任务进度评估器(分布式critics)的数据过滤」

当然,个人认为,后者GR-RL的这点任务进度评估器 应该是受到了π0.6提出的『任务进度评估工作』的启发 - 这个问题在使用范围狭窄的示范数据训练 GCPs 时会进一步加剧。缺少朝向目标的视觉状态转移的显式模型时,此类策略往往会对示范中的状态–动作映射发生过拟合,并且必须依赖稠密监督来弥补缺乏结构化中间引导的不足

这一局限在长时跨度或分布外场景中尤为明显,此时要保持朝向目标的连贯推进,需要进行超出局部观测到的状态转移之外的推理

因此,为了在示范数据之外实现泛化,GCPs 必须显式建模达到期望目标所需的视觉动态过程。缺少这种机制时,策略就无法分辨哪些动作能够实质性地推动朝目标前进,哪些动作仅仅是在局部上匹配示范中观察到的状态–动作相关性

- 世界模型的最新进展为解决这些局限性提供了一条很有前景的途径

8-Sora,详见此文《视频生成Sora的全面解析:从AI绘画、ViT到ViViT、TECO、DiT、VDT、NaViT等》

9-LTX-Video: Realtime Video Latent Diffusion

10-Cosmos world foundation model platform for physical ai

视觉–语言世界模型表明,在任务指令条件下对未来视觉状态进行生成式预测,可以有效支持规划与决策

11-Video prediction policy:A generalist robot policy with predictive visual representations

12-Vidman: Exploiting implicit dynamics from video diffusion model for effective robot manipulation

13-Genie envisioner: A unified world foundation platform for robotic manipulation - 基于这一洞见,作者考虑其在目标条件下的对应形式:目标条件世界模型(goal-conditioned world model)

目标条件世界模型并非从高层语言出发预测未来,而是生成一段合理的中间状态序列,用以弥合当前观测与期望视觉目标之间的鸿沟

————

借助这一能力,弥补了传统 GCPs 的一个根本局限:通过显式表示场景随时间演化的过程,使得朝向特定目标的轨迹在视觉上有据可依,并与任务保持一致

然而,预测一个合理的视觉路径只是问题的一部分。要可靠地执行长时域操作任务,还必须解决更深层次的控制挑战

一个通用的 GCP 必须在全局一致性——即保持对长期目标的忠实性,与局部反应性(即对扰动做出鲁棒响应并在闭环执行中纠正误差)之间取得平衡

全轨迹规划能够提供全局连贯性,但在发生偏离时却非常脆弱;

短时域控制则可以提高鲁棒性,却在长时间任务中很容易丧失方向一致性

这种内在张力构成了将 GCP 部署为通用机器人控制器的一个根本性障碍

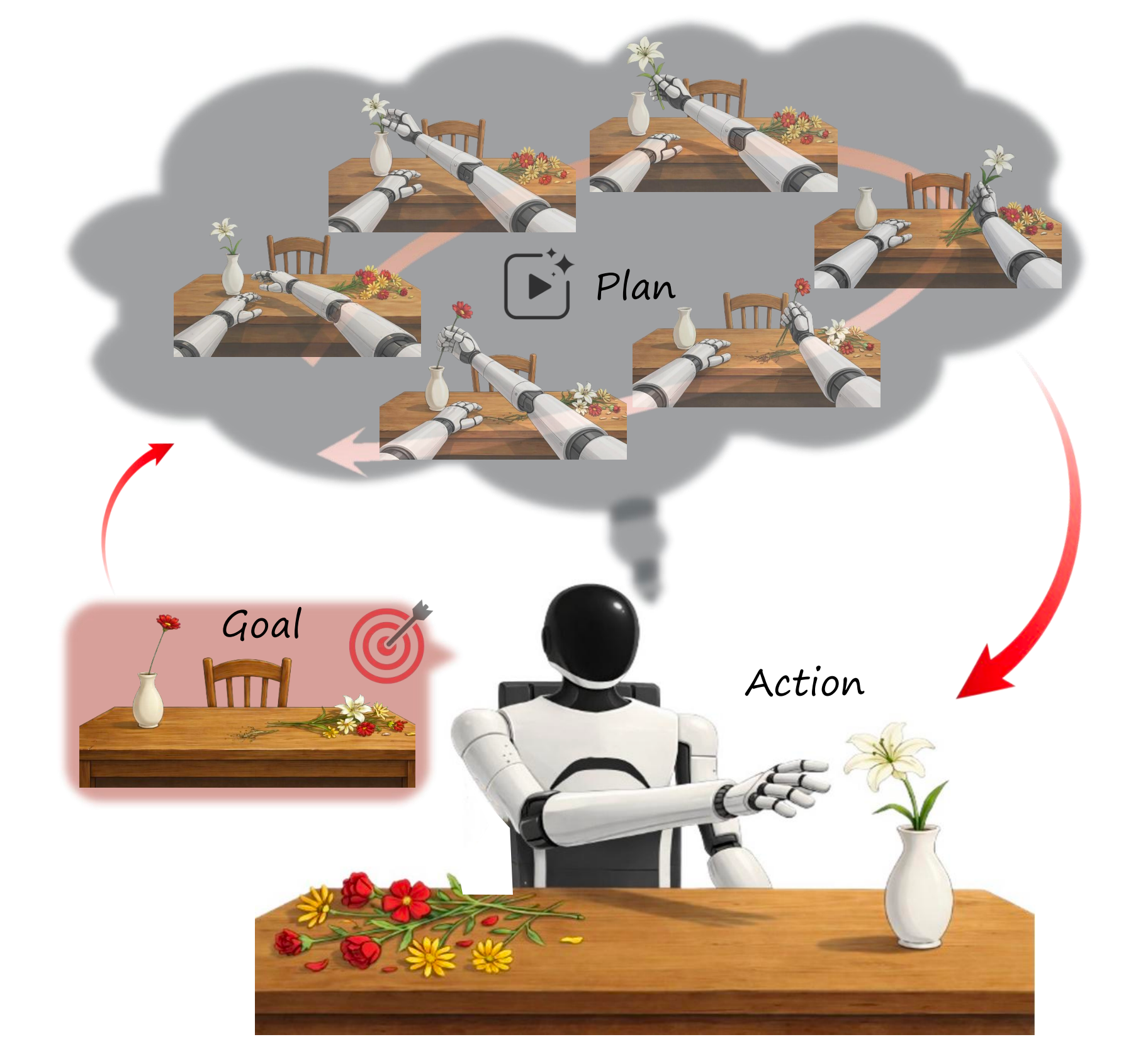

为弥合这一差距,来自Agibot Research的研究者提出 Act2Goal

- 其论文地址为:Act2Goal: From World Model To General Goal-conditioned Policy

其作者包括

Pengfei Zhou1*, Liliang Chen1*, Shengcong Chen1, Di Chen1,

Wenzhi Zhao1, Rongjun Jin1, Guanghui Ren1, Jianlan Luo1† - 其项目地址为:act2goal.github.io

具体而言

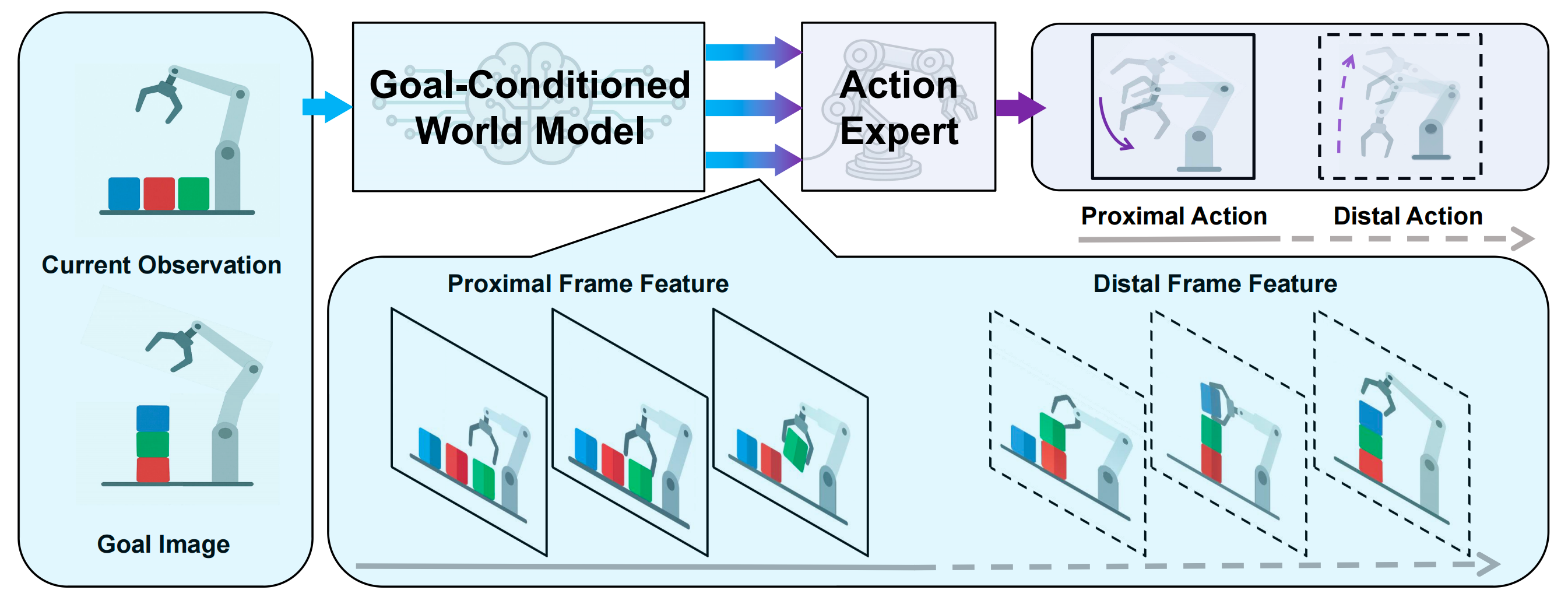

- 这是一种通用的目标条件策略,将目标条件世界模型与一种称为多尺度时间哈希(Multi-Scale Temporal Hashing,MSTH)的新型时间分解机制相结合

MSTH 将生成的视觉轨迹分解为用于细粒度控制的稠密近端帧,以及稀疏且可随时间视野自适应(无需奖励的在线自适应机制)的远端帧,用来锚定全局规划

MSTH decomposes the generated visual trajectory into dense proximal frames for fine-grained control and sparse, horizon-adaptive distal frames that anchor the global plan.

说白了,即将轨迹分解为近端和远端帧,在长时规划与闭环局部控制之间取得平衡

这样的多尺度结构使策略在闭环执行过程中,既能够对长时间跨度的目标进行推理,又能快速响应局部扰动

————

且作者进一步通过逐层交叉注意力将目标条件世界模型与动作专家耦合起来,使中间视觉表征能够在端到端可微分的架构中指导低层次运动控制

We further couple the goal-conditioned world model with an action expert via layer-wise cross-attention,allowing intermediate visual representations to guide low-level motor control in an end-to-end differentiable architecture - 除了基于大规模人类示范数据做离线训练之外,Act2Goal 还通过Hindsight Experience Replay (HER) [14] 支持无需奖励的在线自主改进

通过将自身的 rollout 重新标注为额外的达成目标的轨迹,并通过基于 LoRA 的微调 [15] 高效更新策略,系统可以在没有外部监督的情况下快速适应新的真实场景

解释一下《Hindsight Experience Replay》

- 核心动机:解决“奖励稀疏”难题

在传统的强化学习中,为了让机器人学会复杂的任务(如把物体放入盒子里),研究人员通常需要精心设计“奖励函数”(Reward Shaping)来引导智能体

如果只给智能体一个简单的二元奖励(完成任务给 1,未完成给 0),智能体在早期由于随机探索几乎不可能触碰目标,从而无法获得任何正向反馈,导致学习失败- 灵感来源:从失败中学习

论文作者受人类行为的启发:当我们尝试完成一个目标却失败时,我们并不会一无所获例子:如果你练习打冰球,想把球射入球门却偏向了右侧。标准的强化学习算法会认为这次尝试失败了,学不到东西

HER 的逻辑:虽然你没射中球门,但你完成了一个“把球射入右侧某点”的任务。如果你把那个“错误点”当成目标,这次动作就是完美的- HER 的工作机制

HER 是一种可以与任何离策强化学习Off-policy RL算法(如 DQN, DDPG)结合的技术

通用价值函数(UVFA):HER 要求智能体的策略不仅以“状态”为输入,还要以“目标”为输入

重新标记(Re-labeling):在训练过程中,智能体尝试完成目标但最终达到了状态

。HER 会将这段经历存入经验回放池(Replay Buffer)两次:

以原始目标

存储(奖励通常为 -1 或 0)

“事后诸葛亮”操作:将目标替换为刚才实际达到的状态

,并重新计算奖励(此时奖励为 0 或完成标志),然后存储

————

意义:这保证了即使智能体总是失败,回放池中也会有大量的“成功案例”供其学习如何到达不同的状态HER 实际上形成了一种隐式的“教学大纲”,它证明了通过巧妙地重新利用“失败”经验,让智能体先学会到达附近的状态,再逐渐学会到达更远的目标,让机器人在极度稀疏的反馈中学会极其复杂的技能

1.1.2 相关工作

作者认为,Act2Goal 策略将带有目标条件的世界模型,与能够在线自主改进的动作专家相结合

首先,对于目标条件策略

- 目标条件策略学习旨在训练智能体去达到多种形式的目标,例如视觉目标

2-Goalconditioned reinforcement learning: Problems and solutions

3-Goal-conditioned imitation learning

4-Goal-conditioned on-policy reinforcement learning

16-Go-dice: Goalconditioned option-aware offline imitation learning via stationary distribution correction estimation

17-Goal-conditioned dual-action imitation learning for dexterous dual-arm robot manipulation

18-Mimicplay

19-Hyper-goalnet: Goal-conditioned manipulation policy learning with hypernetworks

跟踪点

20-Any-point trajectory modeling for policy learning

21-Track2act: Predicting point tracks from internet videos enables generalizable robot manipulation

以及运动场

22-Objectcentric 3d motion field for robot learning from human videos

早期工作通过对目标进行重新标注[3, 14-Hindsight experience replay]来增强模仿学习

另一些工作则利用结构化的目标表示[4, 23-Goals as rewardproducing programs]来扩展强化学习 - 最新进展进一步探索

长时序推理[24-Chain-of-action: Trajectory autoregressive modeling for robotic manipulation]

基于关键帧的规划[24]

以及通过程序综合生成目标

[23,25-Assessing adaptive world models in machines with novel games]

其中,GoalGAIL[3]结合HER,从次优或仅有状态的示范中进行学习,从而在模仿学习场景中提升样本效率

CoA[24]提出从目标关键帧反向生成动作序列,以在操作任务中保持长时序的一致性 - 然而,这些方法通常依赖于显式的目标监督,或者在将当前观测与远期目标对齐方面存在困难

Act2Goal 通过引入一个以目标为条件的世界模型,用于模拟结构化的视觉轨迹,并提出多尺度时间哈希(Multi-ScaleTemporal Hashing,MSTH),以支持一致且高效的长时域规划,从而在未见任务上实现更好的泛化能力

其次,对于面向机器人控制的世界模型

- 世界模型已经成为机器人控制中的一种强大工具,使智能体能够模拟环境动力学

26-World models

27-Dream to control: Learning behaviors by latent imagination

28-Mastering diverse domains through world models

生成用于训练的合成数据

29-High-fidelity simulated data generation for real-world zero-shot robotic manipulation learning with gaussian splatting

30-Robotransfer: Geometry-consistent video diffusion for robotic visual policy transfer

或作为学习得到的模拟器来指导策略学习

31-Enerverse-ac:Envisioning embodied environments with action condition

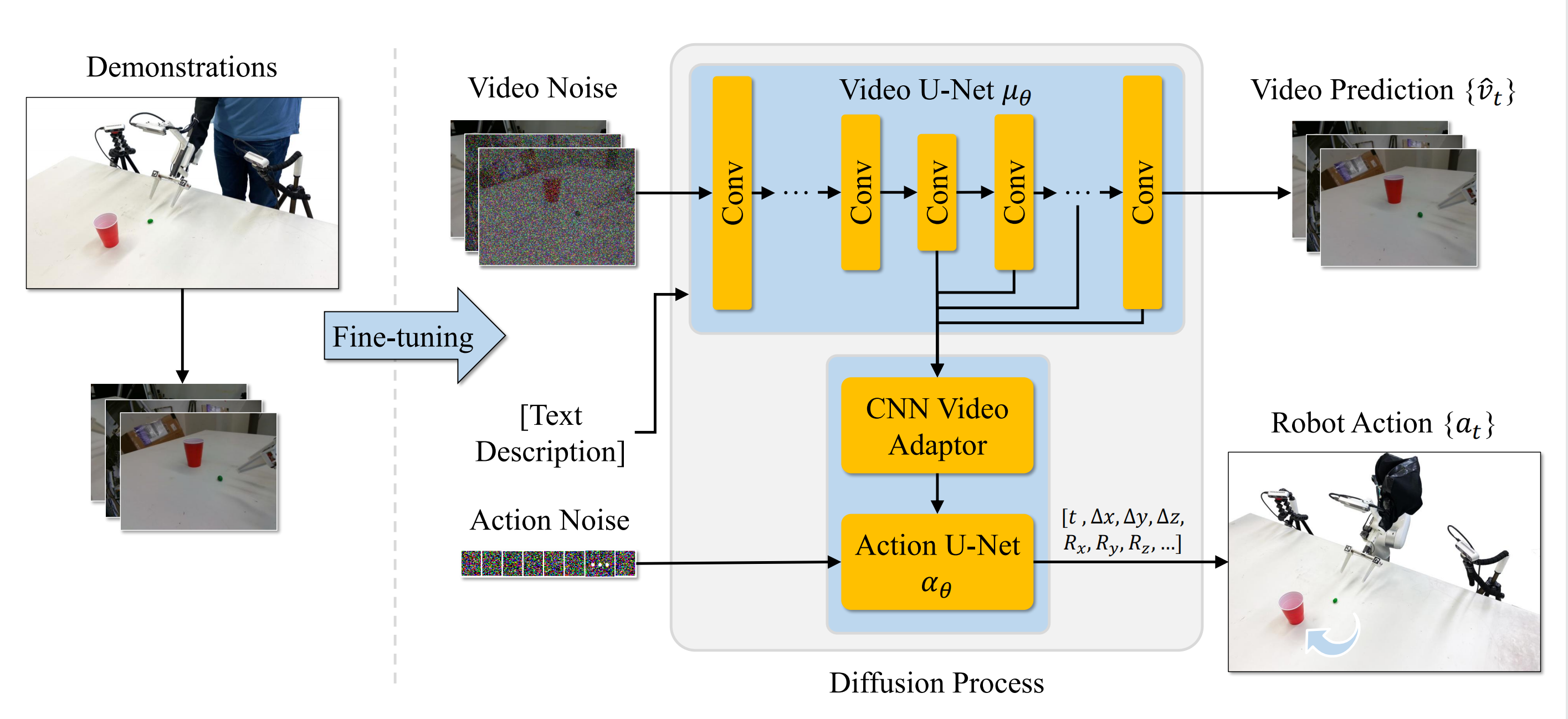

32-Ctrl-world: A controllable generative world model for robot manipulation - 近期的工作进一步将世界模型与动作专家(Action Experts, AEs)结合,以构建策略规划系统

33-Enerverse: Envisioning embodied future space for robotics manipulation

34-Video generators are robot policies

12-Vidman: Exploiting implicit dynamics from video diffusion model for effective robot manipulation

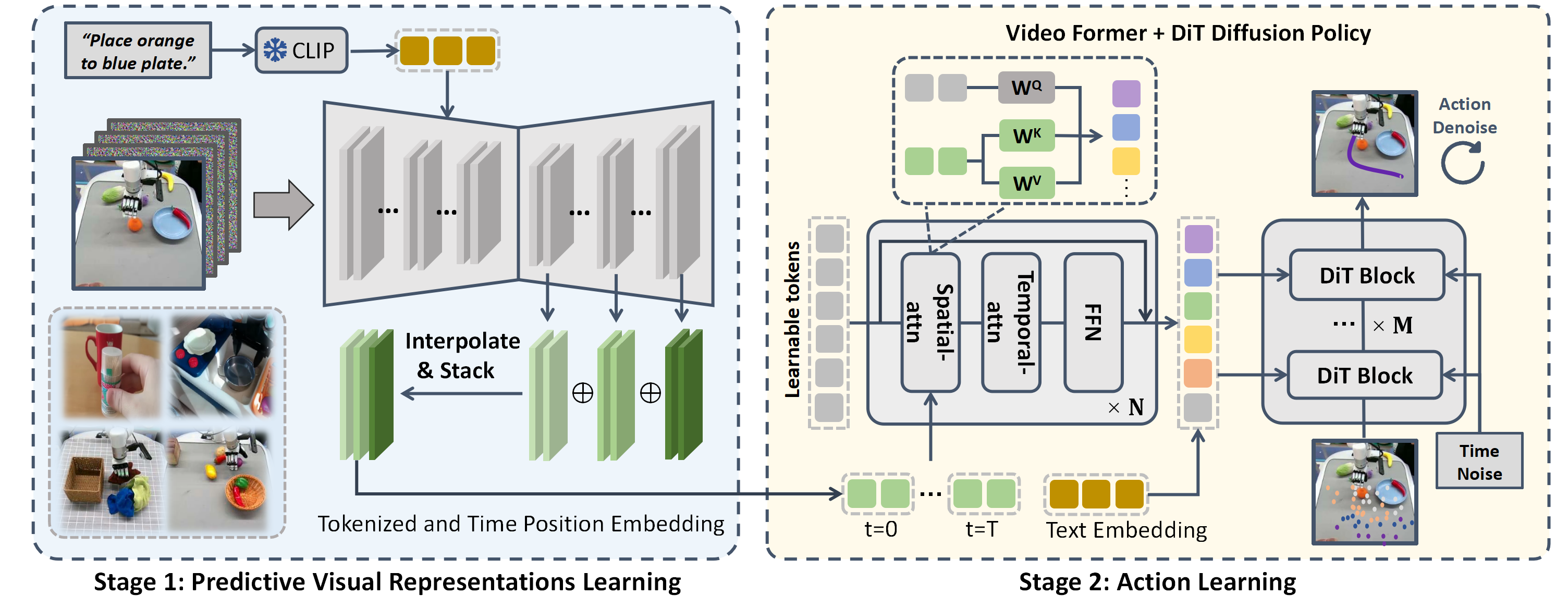

11-Video prediction policy:A generalist robot policy with predictive visual representations,简称 VPP ,来自清华和星动纪元等机构的工作

在第一阶段,VPP 利用机器人和互联网操作数据集,将一个通用的视频基础模型微调为一个面向操作、由文本引导的视频预测(Text-guided Video Prediction, TVP)模型

在第二阶段,使用 video-former 在第一次前向传播过程中聚合来自TVP 模型的表示,随后接上扩散策略头(diffusion policy head)

这种方法使 VPP 能够从预测的未来中学习隐式逆动力学模型,同时保持较高的控制频率

其中,世界模型提供未来状态特征,而 AE 则据此预测相应的动作

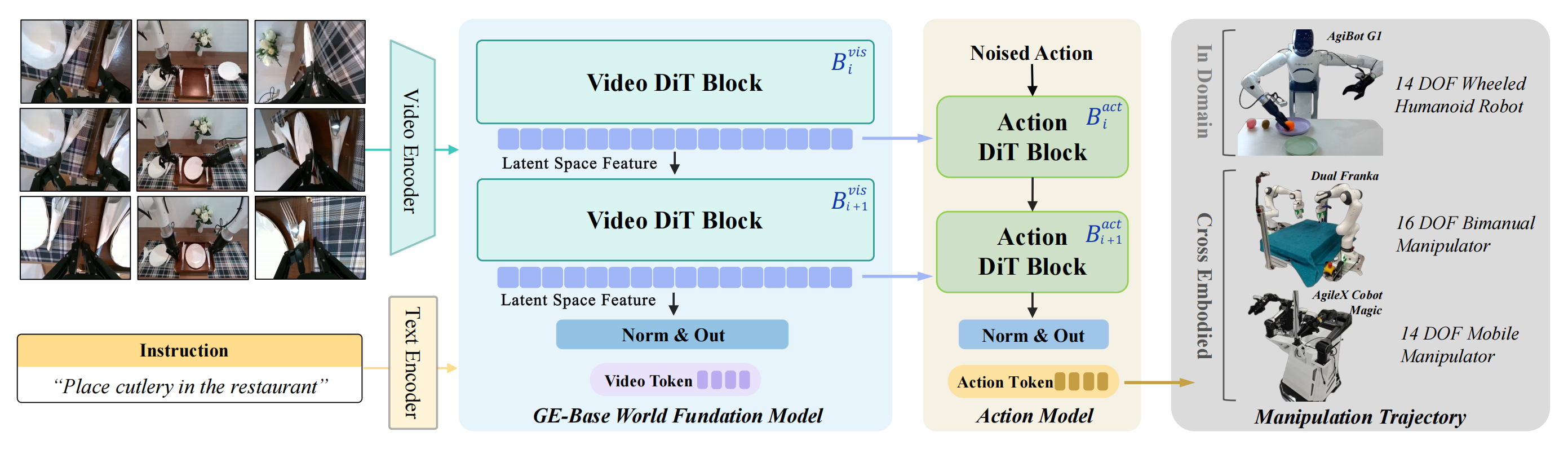

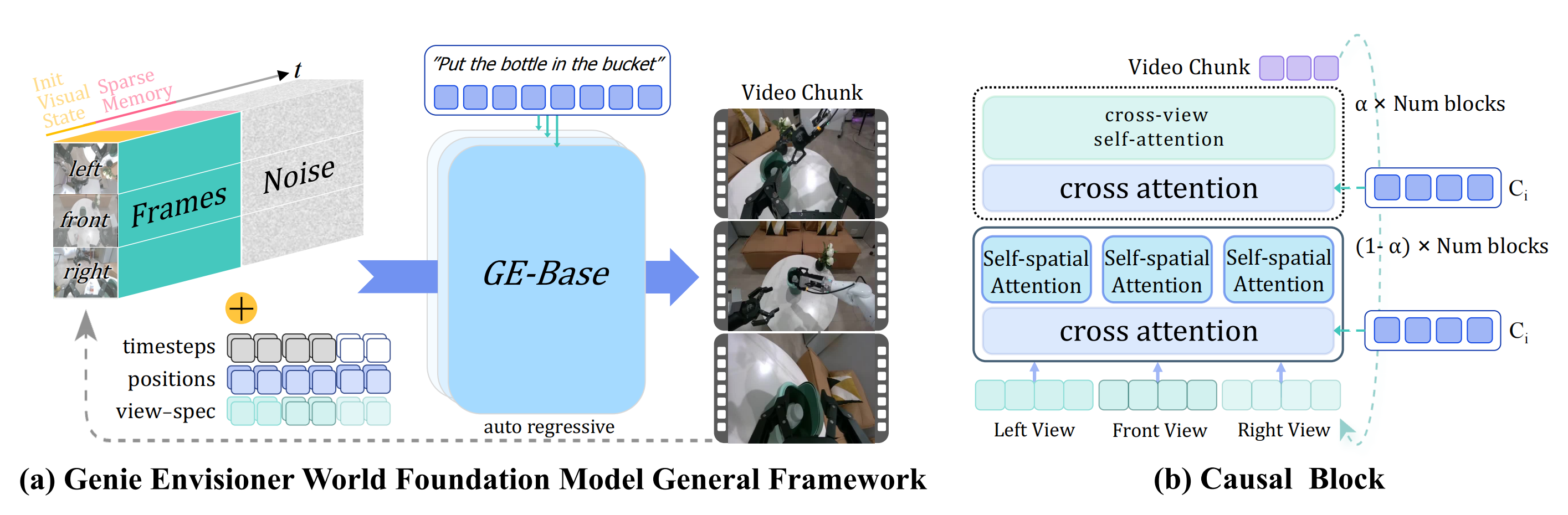

在这些方法中GE-Act [13-Genie envisioner] 采用双模块架构:世界模型根据语言指令预测未来视觉特征,而基于Transformer 的规划器生成动作

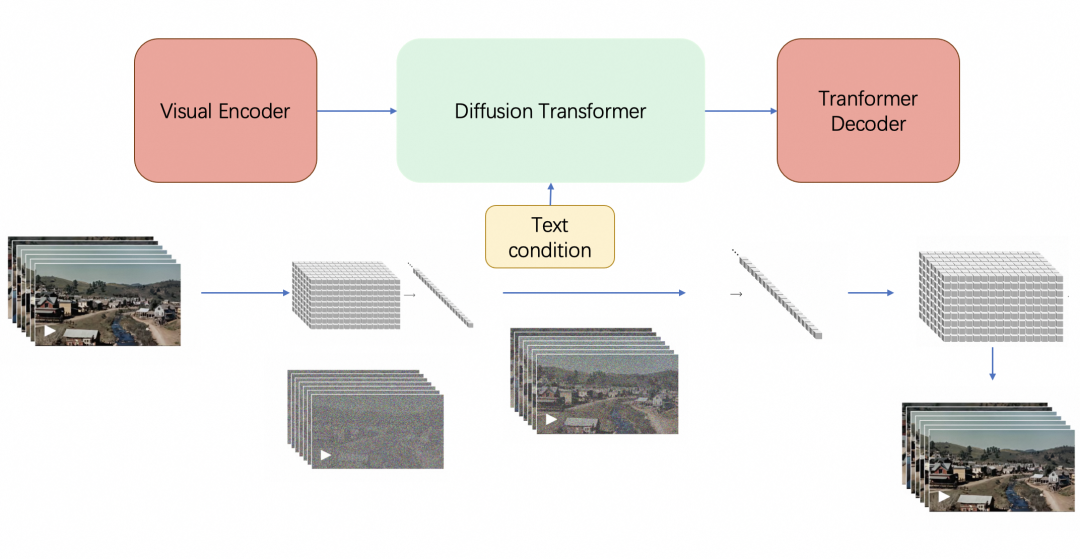

下图是GE-Act 世界动作模型概览

WorldVLA [35]在统一的潜在空间中联合预测视觉与动作,旨在实现更紧密的视觉-动作对齐

- 不同于以往工作,Act2Goal 利用纯视觉的、以目标为条件的世界模型,通过结构化的视觉轨迹来引导策略学习

作者宣称,这是首个将世界模型整合到以目标为条件的策略学习中的工作

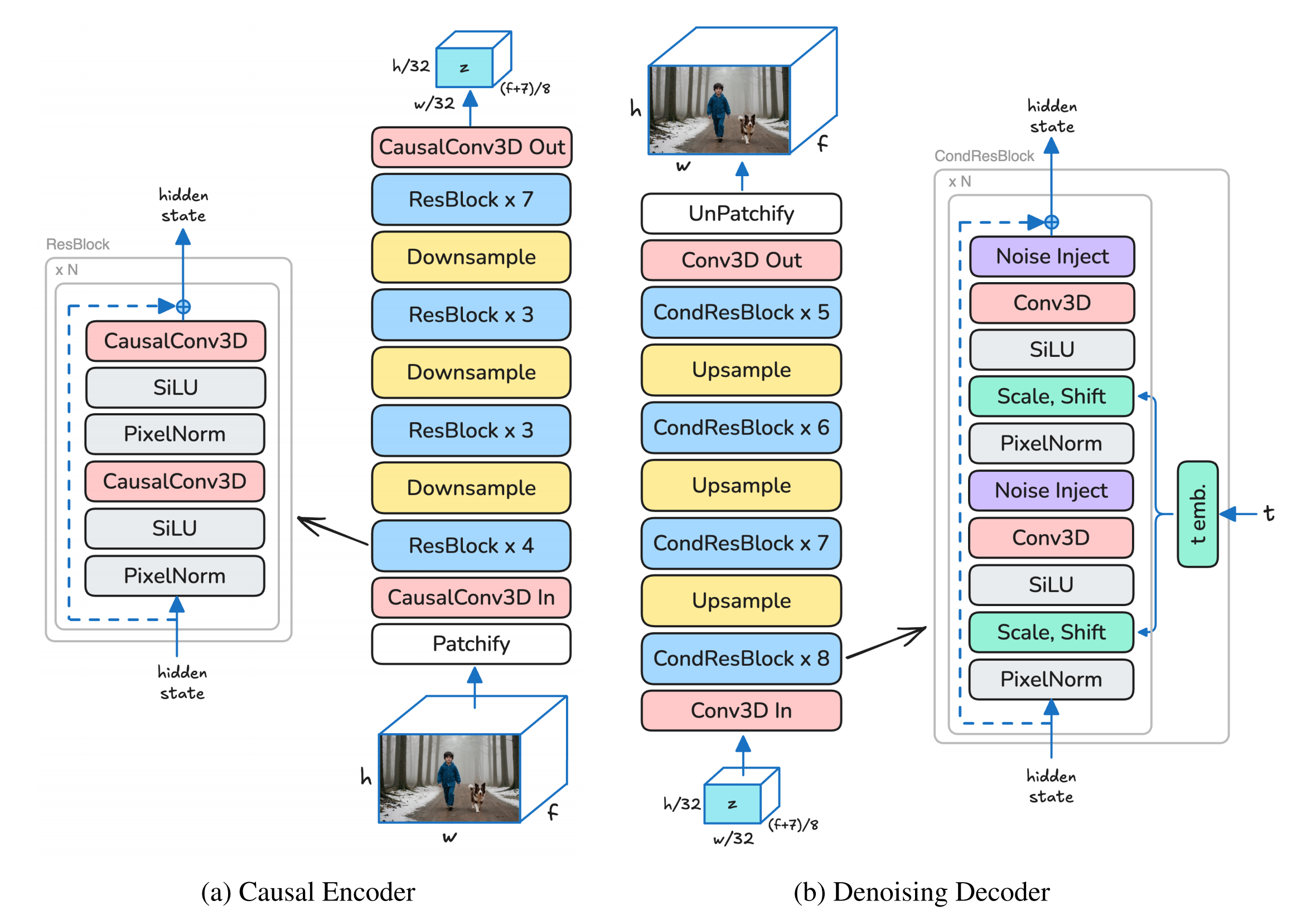

Genie-Envisioner 构建在 GE-Base基础模型(而GE-Base的底层采用 LTX-Video 2B 架构,下图是LTX-VideoVideo-VAE 架构)

之上增添了一个轻量级、参数规模为 1.6 亿的自回归动作解码器

下图是GE-Base World 基础模型概

- 生成流程首先使用共享的视频编码器

对来自初始视觉观测

和稀疏记忆

的多视角观测进行编码

对于每个视角,获得潜在视觉token,记为

和

,其中

每个视角的视觉token 序列通过连接来自和

的token 构成

对应每个视角,初始化一个独立的噪声图

以引导生成

————

为在保持时空对齐的同时区分视角特定信息,作者为每个token 和噪声输入同时添加二维旋转位置嵌入和视角特定的可学习嵌入

- 来自所有视角的这些增强token 和噪声图被拼接起来,并进一步加入时间步编码

,然后输入到DiT 骨干网络中,以自回归方式生成下一个视频片段

最后,对于在线自主改进

- 为在部署过程中提升策略的适应性,近期研究探索了通过交互式模仿学习

如 DAgger

36-A reduction of imitation learning and structured predictionto no-regret online learning

37-Hg-dagger: Inter-active imitation learning with human expert

38-Precise and dexterous robotic manipulation via human-in-the-loop reinforcement learning,即HIL-SERL,详见此文《HIL-SERL——结合“人类离线演示、在线策略数据、人工在线干预”的RL方法:直接真实环境中RL开训,可组装电脑主板和插拔USB》

或上下文学习in-context learning, ICL

39-Mimicdroid

40-Ricl: Adding in-context adaptabilityto pre-trained vision-language-action models

进行在线改进

然而,DAgger 风格的方法需要频繁的专家干预,而 ICL 方法则不会更新模型权重,并且在复杂任务上通常表现受限 - 另一类研究工作利用 Hindsight ExperienceReplay(即HER)[14],及其扩展方法

41-Mher: Model-based hindsight experience replay

42-Usher: Unbiased sampling forhindsight experience replay

43-Relayhindsight experience replay: Self-guided continual re-inforcement learning for sequential object manipulationtasks with sparse rewards.

通过用已达到的状态替换原始目标来重标记状态转移,然后使用强化学习或模仿学习来优化策略

尽管这些方法减少了对显式奖励的需求,但它们仍然依赖于复杂的奖励重标记过程或外部奖励信号 - Act2Goal 在实现完全自主的在线改进方面更进了一步。通过将 HER 风格的重标注与高效的基于LoRA 的微调相结合,它能够直接基于自主收集的执行轨迹进行策略适应,而无需任何任务奖励或人工标注

由此得到一种轻量级、完全自监督的更新机制,适用于现实世界的部署

1.2 从世界模型到通用目标条件策略

Act2Goal框架旨在解决长时域目标条件操作中的两个关键挑战:

- 使动作策略与高层目标语义对齐

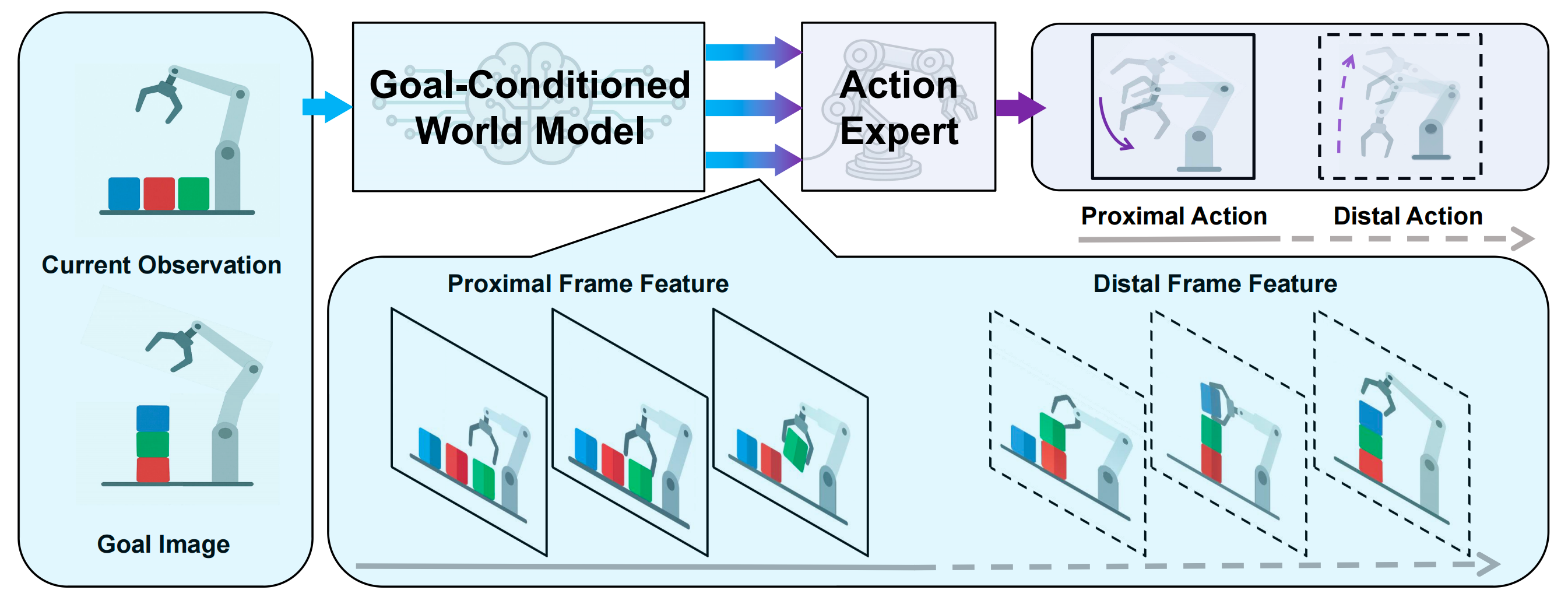

如图 2 所示

作者通过引入目标条件世界模型(GCWM)来应对第一个挑战,该模型以想象的视觉未来来引导策略,从而提供丰富且时间上连贯的表征

- 在较长时间尺度上保持规划效率

为应对第二个挑战,作者提出了多尺度时间哈希(MSTH),通过结构化的时间抽象,使策略既能关注短期执行,又能兼顾长期目标感知

Act2Goal的学习过程由三个阶段组成

- 对GCWM 和动作专家进行联合训练,以对齐它们的表示

- 侧重于动作适配,进一步提升策略的性能

- 引入可选的自主改进机制,使模型在部署过程中能够在新颖场景下自我适应

1.2.1 目标条件化世界模型引导的策略

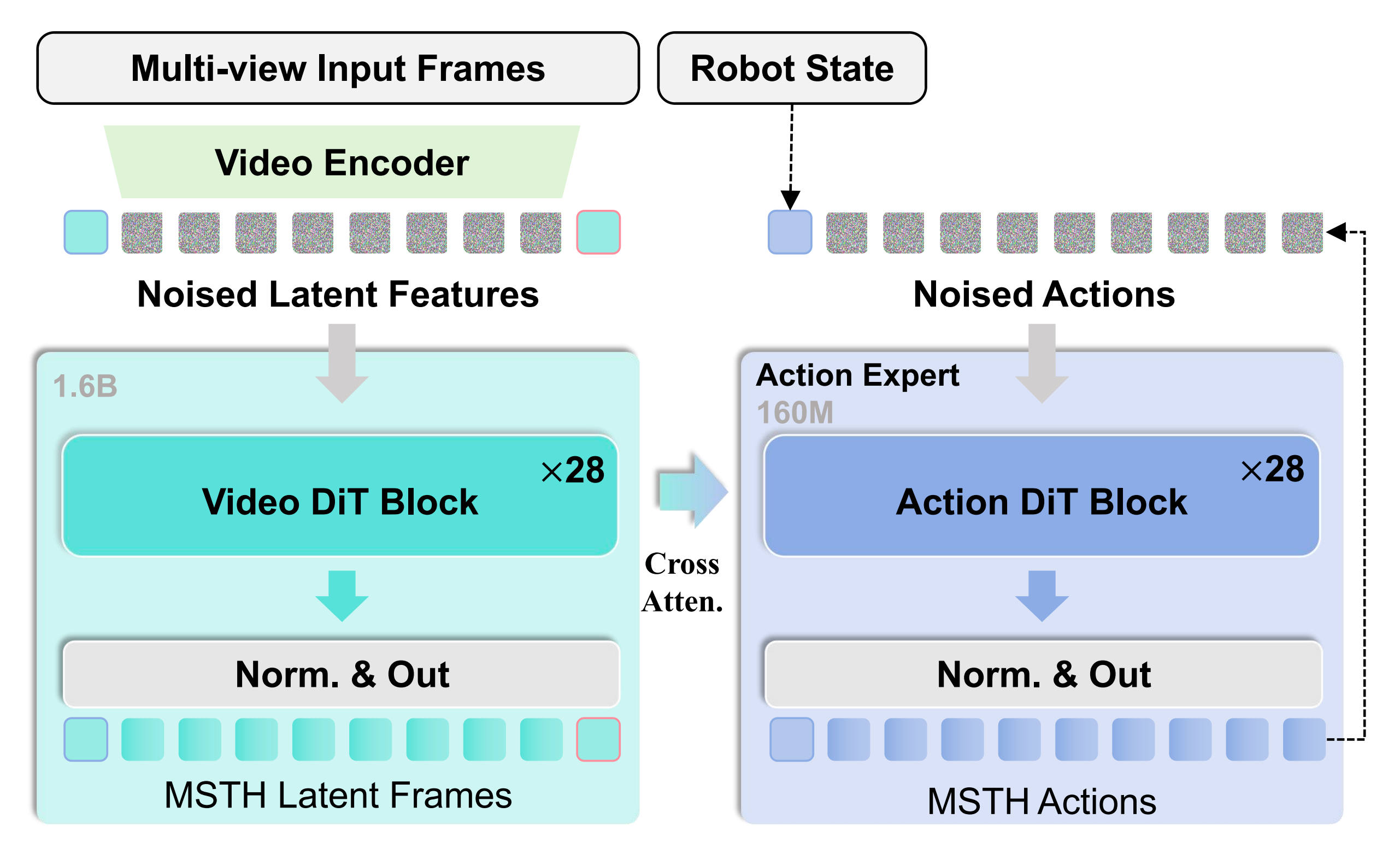

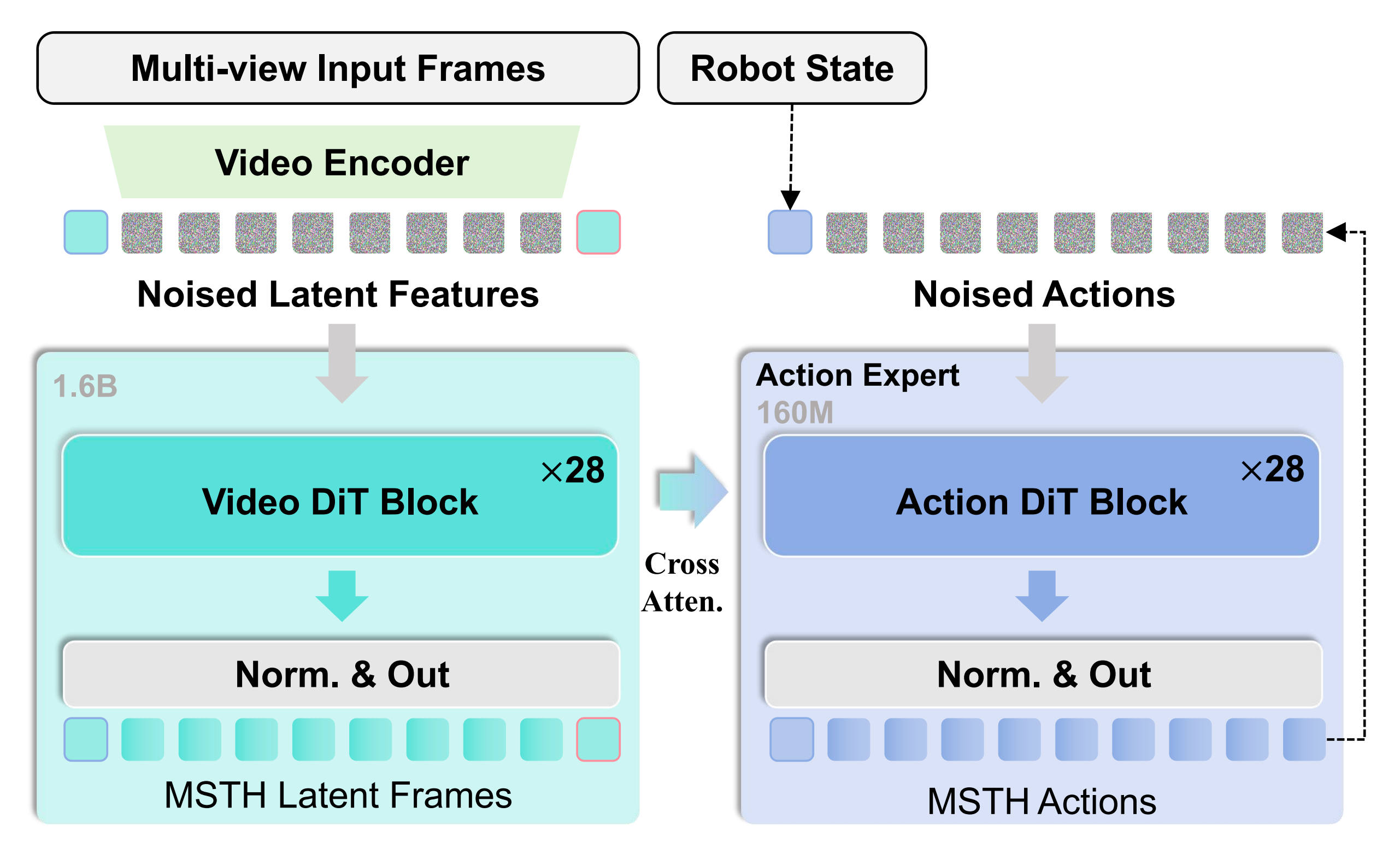

如图3 所示,作者的目标条件世界模型建立在Genie En-visioner 架构之上,并进行了关键修改以适应目标条件策略学习[13-Genie envisioner]

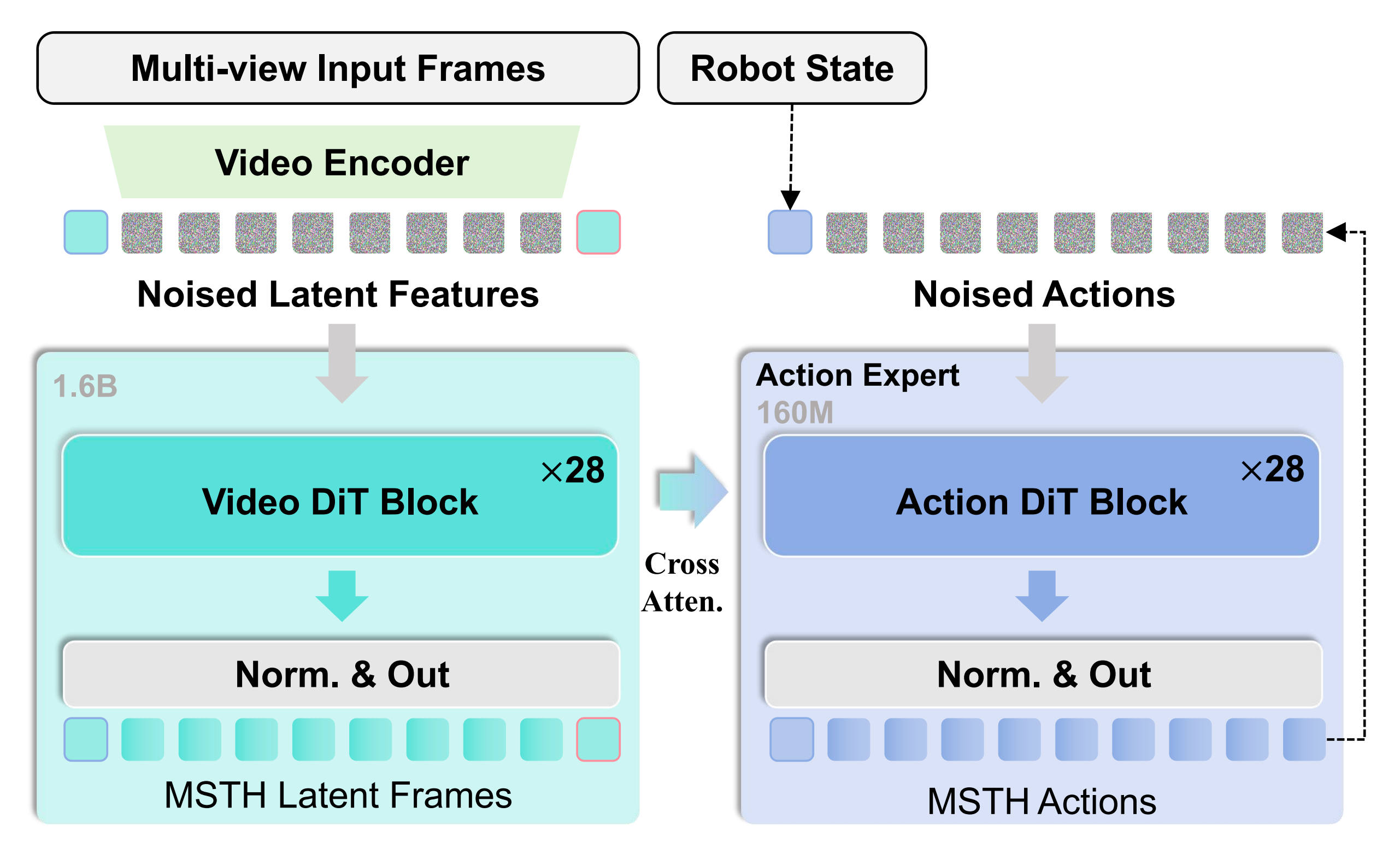

下图展示了 Act2Goal 模型的网络架构

- 左侧,多视角输入帧(包含当前观测和目标)通过视频编码器被编码为潜在表示,并与带噪潜在表示拼接,随后经过 Video DiT 模块精炼为MSTH 潜在帧

On the left, multi-view inputframes, including current observation and goal, are encoded into latents via a video encoder and concatenated with noisylatents, then refined into MSTH latent frames through VideoDiT blocks- 右侧,机器人状态和来自世界模型的多尺度特征(指导进一步的去噪动作生成)通过交叉注意力输入到同构的 ActionDiT 模块中,从而生成具有 MSTH 结构的动作

On the right, the robot state and multi-scalefeatures from the world model are fed via cross-attention intoisomorphic Action DiT blocks, generating MSTH-structuredactions

- 作者引入了一个目标视觉条件,将其与当前观测在隐藏状态序列的维度上进行拼接,同时移除所有语言条件组件,从而构建一个纯视觉的模型

- 该目标条件化世界模型在生成建模中采用连续流匹配方法。该过程可以抽象为:在当前观测和目标状态共同作为条件的情况下——相当于current observetion和goal image

从随机噪声学习到结构化视觉序列的变换

其中,和

分别是当前观测和目标的VAE 压缩潜变量,

表示随机噪声输入,其形状与

相同,而

是流匹配模型,用于在当前观测与目标之间生成潜在帧

- 在推理阶段,模型通过一个确定性的流动过程逐步对含噪潜变量进行细化:

其中是学习到的向量场,引导在多个步骤

上的去噪过程,完成的潜在帧可以使用VAE 解码器:解码为视觉状态

遵循 GE-Act(Genie envisioner)的实现,动作专家采用与世界模型同构的网络架构,具有相同数量的 DiT 模块,但网络宽度有所缩减 [13]

动作轨迹则是使用同时以本体感觉状态

和来自世界模型的多尺度特征

为条件的流匹配过程进行预测

由此可以将动作预测过程形式化为

其中,是动作流匹配模型,ζ 是用于动作生成的噪声输入,

表示分层的转移特征,

是本体状态条件

- 推理过程中针对动作的流匹配过程遵循迭代细化:

其中是用于动作生成的已学习向量场

1.2.2 用于视觉状态和动作的多尺度时间哈希

在Act2Goal的框架中,多尺度时间哈希(Multi-Scale TemporalHashing, MSTH)机制共同引导目标条件世界模型和动作专家,从而实现一致但灵活的多尺度时间抽象

给定总的想象轨迹长度、近端视野长度

和视觉采样步长

,MSTH 将未来轨迹划分为两个片段

- 近段由高频、短视野的视觉状态

组成,它们捕获细粒度的局部动态

- 远段包含

个稀疏采样的视觉状态

,其中索引

由对数间隔决定:

这种对数采样会随着时间视野的扩展产生逐渐增大的时间间隔,从而提供粒度较粗但与目标保持一致的长期指导

预测的动作序列遵循相同的多尺度结构,但与视觉相比有一个重要区别

- 近端动作在每个时间步都被预测,

,即使在视觉状态被以步长

进行子采样时,也能实现稠密的运动控制

- 相反,远端动作

与远端视觉状态对齐,并作为长时间跨度的引导

在部署过程中,只有近端动作会被执行,而远端预测保持为潜在状态,用于引导长期目标的遵循

1.2.3 两阶段离线训练

为了赋予 Act2Goal 强大的泛化能力,作者首先通过大规模离线模仿学习来训练模型。整个训练过程包含两个主要阶段,旨在确保转移轨迹预测(transition trajectory prediction)这一训练目标与最终用于指导行动规划的目标高度一致

- 在第一阶段,作者对一个预训练的世界模型进行微调,使其适应用于转移轨迹预测任务,即在初始观测与目标条件之间,按照 MSTH 分布生成多视角视频帧

为了使转移轨迹预测与动作规划目标保持一致,作者利用 flow matching 同时联合训练转移轨迹预测任务和动作生成任务

视觉生成组件的训练目标遵循 flow matching 的损失形式:

联合训练目标通过平衡系数λ 将这两个损失结合起来。在作者的实验中,他们设置λ = 0.1 :

这种联合优化确保了目标条件世界模型学会生成不仅在视觉上可信、而且可付诸行动的视觉轨迹,从而为后续的策略学习阶段奠定坚实基础 - 在第二个训练阶段,作者采用行为克隆对整个模型进行端到端微调,仅使用动作流匹配损失

,进一步强化其动作规划能力

该阶段重点在于将完整的流程(从视觉感知到动作执行)与专家演示对齐

来自动作损失的梯度传播到动作生成组件和目标条件世界模型中,使视觉表征能够针对动作规划进行特定优化

作者认为,这种两阶段离线训练方法使 Act2Goal 能够获得稳健的世界理解和动作生成能力,并且可以有效迁移到未见过的环境和任务中

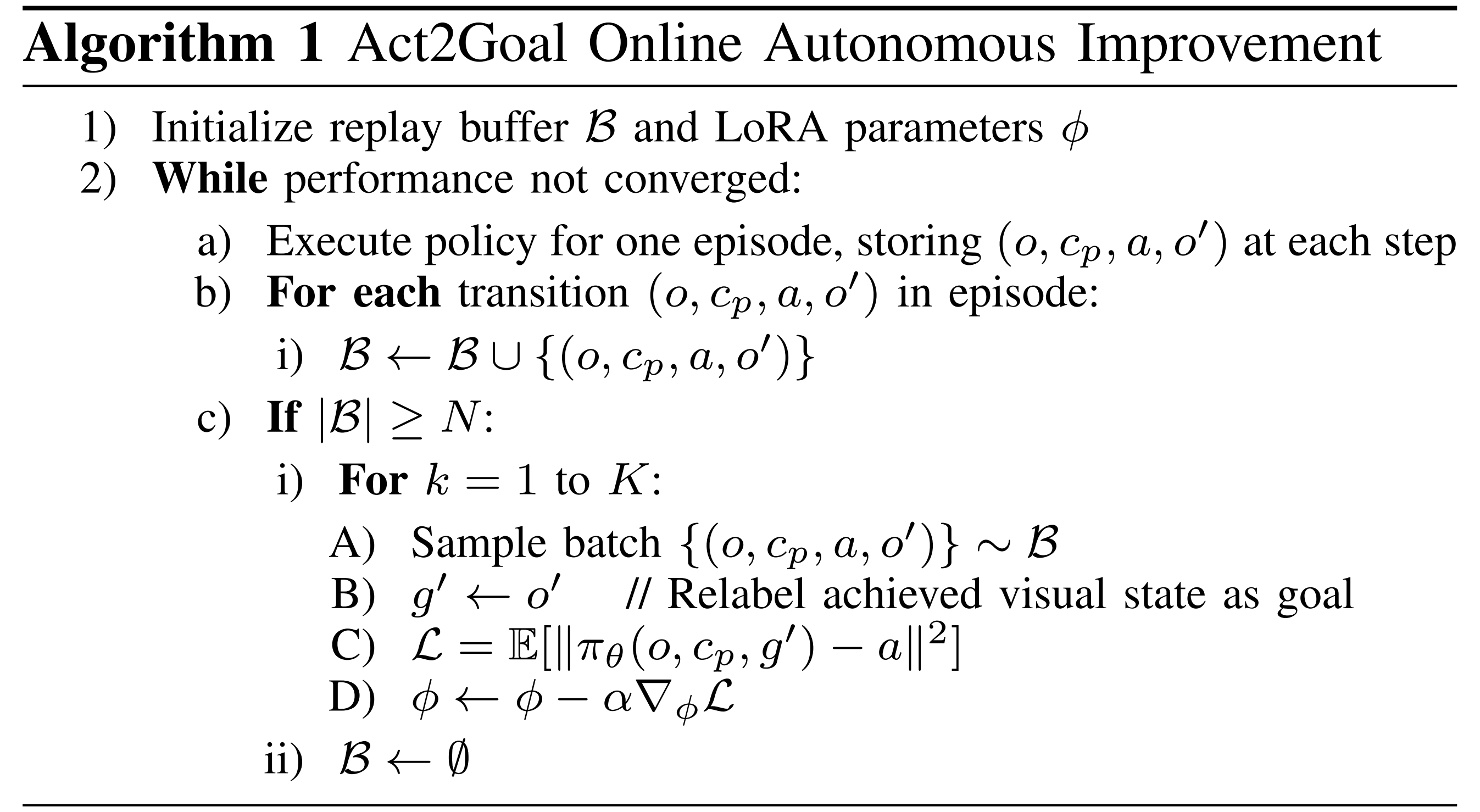

1.2.4 在线自主改进:没有外部奖励、没有人工干预

尽管模型在离线模仿学习之后表现出很强的泛化能力,但在部署到实体机器人上时,要在全新的任务、环境、物体以及运动控制链上实现高性能仍然具有挑战性—这是基于模仿学习的策略的一个常见局限

为了解决这一问题,作者引入了一种基于 HindsightExperience Replay(HER)的在线自主改进框架,从而在部署过程中实现性能的自主提升 [14]

如算法 1 所示,系统的运行流程如下:

- 在给定期望目标条件的情况下,模型进行推理并执行动作。每一步推理——包括起始观测潜变量

、初始先验状态

、输出动作

,以及执行后的结果观测潜变量

——都会被自动收集到边缘设备上的回放缓冲区中

关键在于,无论该状态转移是否成功达到预期目标,作者都会自动将目标条件重标记为该步推理结束时机器人的观测,从而无需对转移进行人工标注

当回放缓冲区达到预设的容量阈值时,作者使用其中的转移执行固定次数的端到端训练迭代,训练方式与离线模仿学习的第 2 阶段相同 - 为保证高效的端侧训练,仅更新Act2Goal 模型中新引入的 LoRA 层,而基础模型参数保持冻结 [15]

在完成固定迭代次数的训练后,回放缓冲区被清空,系统通过 rollout继续收集新数据,如此循环,直到性能满足预期

作者为不同任务设置最大推理次数;超过该阈值时会自动触发机器人复位。在真实机器人实验中,唯一需要的人为干预只是必要时对实验场景进行手动复位或调整

为了方便大家更好的理解整个流程,我还是不厌其烦的把上述伪代码的每一行以及每一个公式、符号,再细致的解释下

整个流程是一个不断循环的闭环:执行 (Rollout) -> 收集数据 -> 自我复盘 (Relabel) -> 微调模型 (Optimize)

它的核心思想结合了 Hindsight Experience Replay (HER)(事后经验回放)和 LoRA (Low-Rank Adaptation)(低秩微调),让机器人通过“复盘”自己的行为来学习,哪怕任务失败了,也能从中学到“如何到达当前这个错误状态”的经验

1. 初始化阶段 (Initialization)

伪代码: 1) Initialize replay buffer B and LoRA parameters

含义:

初始化一个经验回放缓冲区

,用于临时存储机器人执行任务时的数据

初始化 LoRA 参数。为了在边缘设备上实现快速训练,作者冻结了原本庞大的基础模型参数,只引入并训练少量的 LoRA 层

2. 外层循环:持续改进

伪代码: While performance not converged:

含义:这是一个持续运行的循环,直到机器人的成功率达到预期或收敛。在实验中,这通常持续数轮(Rounds)

3. 执行与数据收集 (Rollout)

// PS,为方便大伙一目了然,我特意用:深紫色且加粗代表对代码做一次缩进,正常紫色代表对代码做两次缩进,淡紫色则代表对代码做三次缩进

伪代码: a) Execute policy for one episode, storing (o, c_p, a, o') at each step伪代码: b) For each transition (o, c_p, a, o') in episode:

伪代码: i) B <- B U {(o, c_p, a, o')}

含义:机器人尝试去执行一个任务(比如“把瓶子放进盘子”)。无论成功还是失败,它都会记录下每一步的经历

符号解释:

(Observation): 当前时刻的视觉观测(例如当前摄像头看到的图像)

(Proprioceptive state): 机器人的本体状态(例如关节角度、末端执行器位置)

(Action): 机器人采取的动作

(Next Observation): 执行动作

之后,环境变成的新样子(下一帧图像)

:将这一步的数据存入缓冲区

4. 触发训练条件

伪代码: c) If |B| >= N

含义:当缓冲区

积累的数据量达到设定的阈值

时,暂停收集,开始训练

注意:在附录中提到,实验中

的大小设为 20

5. 内层循环:优化更新 (Optimization Loop)

伪代码: i) For k = 1 to K:

伪代码: A) Sample batch {(o, c_p, a, o')} ~ B

含义:进行

次迭代训练(实验中设为 10 个 epoch)。从缓冲区中随机采样一批数据

6. 关键步骤:事后目标重标记 (Hindsight Relabeling)

伪代码: B) g' <- o' // Relabel achieved visual state as goal

这是整个算法的灵魂步骤

解释:

在原始任务中,机器人的目标是

(例如“把杯子放在桌子上”),但机器人可能做错了,把杯子扔到了地上,此时达到的状态是

(杯子在地上)

重标记 (Relabeling):虽然机器人没有达成原始目标

,但它成功地达成了“把杯子扔到地上”这个状态

因此,我们将目标修改为逻辑:机器人对自己说:“虽然我没完成原本的任务,但我刚刚的操作

,确实能让我从状态

变成状态

所以我学会了一条新规则:如果你想去,就像刚才那样做。”

这消除了对人工标注数据或成功奖励信号的依赖7. 损失计算与参数更新

伪代码: C) L = E[|| π_θ(o, c_p, g') - a ||^2]

伪代码: D) φ <- φ - α * ∇_φ L

这里是具体的数学更新过程,我们需要拆解每一个符号:

公式 1 (损失函数):

: Loss (损失值),代表预测动作与实际动作的差距

: Act2Goal 策略网络 (Policy Network)。输入是当前观测、本体状态和目标,输出是动作

: 重标记后的目标 (Relabeled Goal)。注意这里不是原始目标,而是刚才实际达到的状态

: 当时的观测和本体状态

: 当时实际执行的动作

物理含义:这是一个行为克隆 (Behavior Cloning) 损失。我们在教神经网络:“当你看到

和

,并且想去

时,你应该输出动作

公式 2 (参数更新):

: LoRA 参数。注意这里更新的不是整个网络

,而是仅更新 LoRA 部分的权重

: Learning Rate (学习率),控制更新步长

: 对参数

求梯度

物理含义:通过梯度下降法,调整 LoRA 参数,使得网络下次再遇到类似情况(想去

)时,能更准确地生成动作

8. 清空缓冲区

伪代码: ii) B <- empty

含义:训练一轮结束后,清空缓冲区

目的:确保下一轮训练使用的是最新的策略收集到的新数据(On-policy 或 Near-policy 的思想),防止旧的、质量差的数据干扰后续的高水平训练

总结:为什么这个流程有效?

无需人类老师:通过将

,机器人把每一次“失败”都转化为了另类任务的“成功”演示

极速适应:因为它不需要训练整个大模型,只微调 LoRA 层,且缓冲区很小(仅20个样本),所以可以在几分钟内完成适应

解决分布外 (OOD) 问题:当机器人遇到从未见过的物体或环境时,最初的尝试可能是乱动的。但通过这个流程,它迅速记住了这些乱动产生的后果(环境的视觉动态),从而逐步掌握该环境下的物理规律

// 待更

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)